La startup d'IA Anthropic, soutenue par Google et des centaines de millions de dollars en capital-risque (et peut-être bientôt des centaines de millions de plus), annoncé la dernière version de leur technologie GenAI, Claude. Et l'entreprise affirme qu'elle surpasse le chatbot d'OpenAI, GPT-4, en termes de performances.

Claude 3, comme on appelle le nouveau GenAI d'Anthropic, est une famille de modèles : Claude 3 Haiku, Claude 3 Sonnet et Claude 3 Opus, Opus étant le plus puissant. Tous montrent des « capacités accrues » en matière d'analyse et de prévision, affirme Anthropic, ainsi que des performances améliorées sur des benchmarks spécifiques par rapport à des modèles comme ChatGPT et GPT-4 (mais pas GPT-4 Turbo) et Gemini 1.0 Ultra de Google (mais pas Gemini 1.5 Pro). ). .

Notamment, Claude 3 est le premier GenAI multimodal d'Anthropic, ce qui signifie qu'il peut analyser à la fois du texte et des images, à l'instar de certaines versions de GPT-4 et Gemini. Claude 3 peut traiter des photographies, des tableaux, des graphiques et des schémas techniques, en extrayant des fichiers PDF, des diaporamas et d'autres types de documents.

Mieux que certains rivaux de GenAI, Claude 3 peut analyser plusieurs images en une seule requête (jusqu'à un maximum de 20). Cela vous permet de comparer et de contraster les images, note Anthropic.

Mais le traitement d'image de Claude 3 a des limites.

Anthropic a empêché les modèles d'identifier les personnes, se méfiant sans doute des implications éthiques et juridiques. Et l'entreprise admet que Claude 3 est sujet aux erreurs avec des images de « mauvaise qualité » (moins de 200 pixels) et a des difficultés avec les tâches impliquant un raisonnement spatial (par exemple, lire le cadran d'une horloge analogique) et le comptage d'objets. (Claude 3 XNUMX ne peut pas donner de données exactes). nombre d'objets dans les images).

crédits: Anthropique

Claude 3 non plus va générer une œuvre d'art. Les modèles analysent strictement les images, du moins pour le moment.

Qu'il s'agisse de texte ou d'images, Anthropic affirme que les clients peuvent s'attendre à ce que le Claude 3 suive mieux les instructions en plusieurs étapes et produise des résultats structurés dans des formats tels que JSON et converser dans des langues autres que l'anglais par rapport à leurs prédécesseurs. Claude 3 devrait également refuser de répondre moins fréquemment aux questions grâce à une « compréhension plus nuancée des demandes », estime Anthropic. Et bientôt, les modèles citeront la source de leurs réponses aux questions afin que les utilisateurs puissent les vérifier.

"Claude 3 a tendance à générer des réponses plus expressives et plus engageantes", écrit Anthropic dans un article complémentaire. « Il est plus facile à guider et à diriger par rapport à nos modèles existants. Les utilisateurs devraient constater qu’ils peuvent obtenir les résultats souhaités avec des invites plus courtes et plus concises.

Certaines de ces améliorations proviennent du contexte élargi de Claude 3.

Le contexte d'un modèle, ou fenêtre contextuelle, fait référence aux données d'entrée (par exemple, du texte) que le modèle prend en compte avant de générer des résultats. Les modèles dotés de petites fenêtres contextuelles ont tendance à « oublier » le contenu des conversations, même très récentes, ce qui les amène à s’éloigner du sujet, souvent de manière problématique. Comme avantage supplémentaire, les modèles riches en contexte peuvent mieux capturer le flux narratif de données qu’ils reçoivent et générer des réponses contextuellement plus riches (du moins hypothétiquement).

Anthropic indique que Claude 3 prendra initialement en charge une fenêtre contextuelle de 200.000 150.000 jetons, équivalent à environ 1 700.000 mots, et que certains clients bénéficieront d'une fenêtre contextuelle de 1.5 million de jetons (~ XNUMX XNUMX mots). Ceci est comparable au dernier modèle GenAI de Google, le Gemini XNUMX Pro mentionné ci-dessus, qui offre également une fenêtre contextuelle pouvant aller jusqu'à un million de jetons.

Maintenant, ce n’est pas parce que Claude 3 est une mise à jour de ce qui précède qu’il est parfait.

Dans un document technique, Anthropic admet que Claude 3 n'est pas à l'abri des problèmes qui affligent d'autres modèles GenAI, à savoir les biais et les hallucinations (c'est-à-dire inventer des choses). Contrairement à certains modèles GenAI, Claude 3 ne peut pas effectuer de recherche sur le Web ; les modèles ne peuvent répondre aux questions qu’en utilisant des données antérieures à août 2023. Et bien que Claude soit multilingue, il ne parle pas aussi couramment certaines langues « à faible revenu » comme l’anglais.

Mais des mises à jour prometteuses d'Anthropic pour Claude 3 sont attendues dans les mois à venir.

"Nous ne pensons pas que l'intelligence des modèles soit proche de ses limites et nous prévoyons de publier des améliorations de la famille de modèles Claude 3 dans les mois à venir", écrit la société dans un communiqué. article de blog.

Opus et Sonnet sont désormais disponibles sur le Web et via l'API et la console de développement d'Anthropic, la plateforme Bedrock d'Amazon et Vertex AI de Google. Le haïku suivra plus tard cette année.

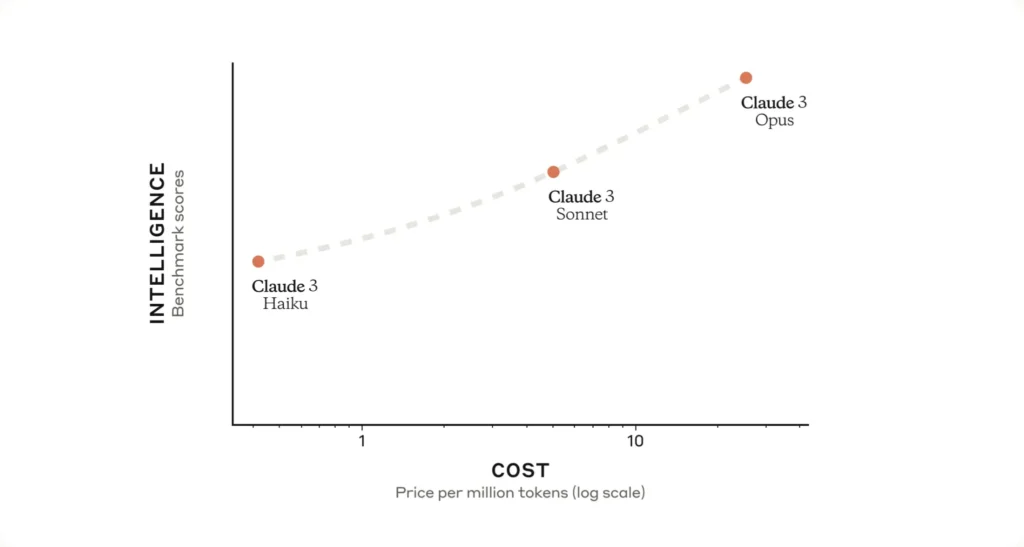

Voici la répartition des prix:

- Opus : 15 $ par million de jetons entrants, 75 $ par million de jetons sortants

- Sonnet : 3 $ par million de jetons entrants, 15 $ par million de jetons sortants

- Haïku : 0,25 $ par million de jetons entrants, 1,25 $ par million de jetons sortants

Voilà donc Claude 3. Mais qu'est-ce qu'une vue plongeante ?

L'ambition d'Anthropic est de créer un algorithme de nouvelle génération pour « l'auto-apprentissage de l'IA ». Un tel algorithme pourrait être utilisé pour créer des assistants virtuels capables de répondre aux e-mails, d'effectuer des recherches et de générer des œuvres d'art, des livres, etc., dont certains ont déjà été testés avec des entreprises telles que GPT-4 et d'autres grands modèles de langage.

Anthropic y fait allusion dans le billet de blog susmentionné, affirmant qu'il prévoit d'ajouter des fonctionnalités à Claude 3 qui améliorent ses capacités prêtes à l'emploi en permettant à Claude d'interagir avec d'autres systèmes, de coder « de manière interactive » et d'offrir « des agents avancés ». capacités. » .»

Ce dernier point nous rappelle libérerpar OpenAI qui vise à créer un agent logiciel pour automatiser des tâches complexes, comme transférer des données d'un document vers un tableur ou compléter automatiquement des notes de frais et les saisir dans un logiciel de comptabilité (par exemple). OpenAI propose déjà une API qui permet aux développeurs de créer des « expériences de type agent » dans leurs applications, et Anthropic aurait l'intention d'offrir des fonctionnalités similaires.

Pourrions-nous ensuite voir un imageur anthropique ? Ce serait surprenant. Les générateurs d’images font aujourd’hui l’objet de nombreuses controverses, principalement pour des raisons liées au droit d’auteur et aux préjugés. Récemment, Google a été contraint de désactiver son générateur d’images après avoir injecté de la diversité dans les images au mépris ridicule du contexte historique. Et plusieurs vendeurs d'imageurs sont engagés dans des batailles juridiques avec des artistes qui les accusent de profiter de leur travail en formant GenAI à ce travail sans offrir de compensation ni de crédit.

Il sera intéressant de voir l'évolution de la technique d'Anthropic pour former la GenAI, « l'IA constitutionnelle », qui, selon la société, rend le comportement de sa GenAI plus facile à comprendre, plus prévisible et plus facile à ajuster selon les besoins. L’IA constitutionnelle vise à fournir un moyen de aligner l’IA sur les intentions humaines, en faisant en sorte que les modèles répondent aux questions et effectuent des tâches en utilisant un ensemble simple de principes directeurs. Par exemple, pour Claude 3, Anthropic a déclaré avoir ajouté un principe, éclairé par des commentaires participatifs, qui demande aux modèles d'être compréhensifs et accessibles aux personnes handicapées.

Quelle que soit la fin d’Anthropic, elle sera à long terme. Selon une présentation divulguée en mai de l'année dernière, la société vise à lever jusqu'à 5.000 milliards de dollars au cours des 12 prochains mois, ce qui pourrait constituer la base dont elle a besoin pour rester compétitive face à OpenAI. Après tout, les modèles de formation coûtent cher. C'est en bonne voie, avec 2 milliards et 4 milliards de dollars de capitaux engagés respectivement par Google et Amazon, et plus d'un milliard combiné provenant d'autres bailleurs de fonds.