Adobe affirme construire un modèle d'intelligence artificielle pour générer des vidéos. Mais cela ne révèle pas exactement quand ce modèle sera publié, ni grand-chose à ce sujet, juste le « fait » qu'il existe.

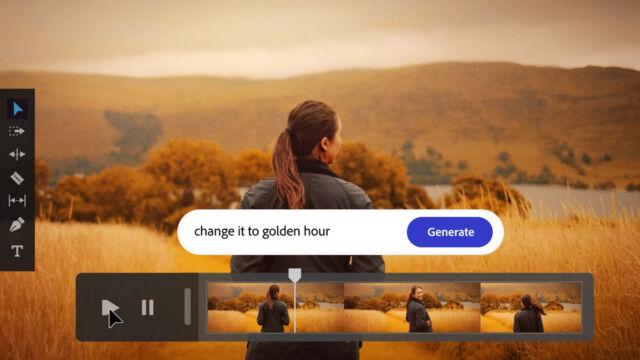

Proposé comme une sorte de réponse à Sora d'OpenAI, Image 2 de Google et aux modèles du nombre croissant de startups dans l'espace vidéo naissant de l'IA générative, le modèle d'Adobe, qui fait partie de la famille croissante de produits d'IA générative Firefly de la société, fera son chemin vers Premiere Pro, la suite de montage vidéo phare d'Adobe, et arrivera plus tard cette année, indique Adobe.

Comme de nombreux outils vidéo d'IA générative aujourd'hui, le modèle d'Adobe crée des images à partir de zéro (soit un message, soit des images de référence) et alimente trois nouvelles fonctionnalités dans Premiere Pro : l'ajout d'objets, la suppression d'objets et l'extension générative.

Ces fonctionnalités sont explicites.

L'ajout d'objets permet aux utilisateurs de sélectionner un segment d'un clip vidéo (par exemple, le tiers supérieur ou le coin inférieur gauche) et de saisir un message pour insérer des objets dans ce segment. Lors d'un briefing, un porte-parole d'Adobe a montré une image fixe d'une mallette réelle pleine de diamants générée par le modèle d'Adobe.

Image: Diamants générés par l'IA, Adobe.

La suppression d'objets supprime des éléments des vidéos, tels que des microphones sur une extension ou un poteau ou tasses à café en arrière-plan d'une vidéo.

Suppression d'objets avec l'IA. On voit que les résultats ne sont pas entièrement parfaits. Image: Adobe

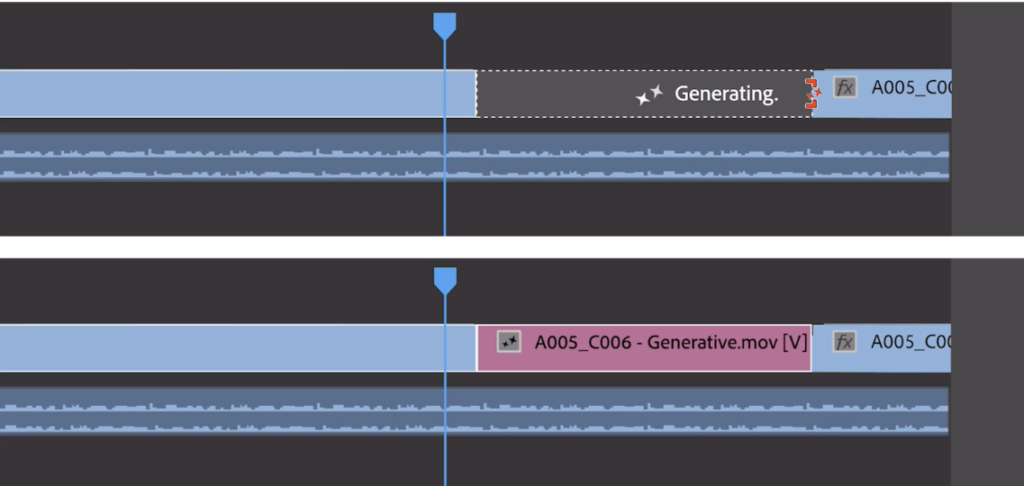

Quant à l'extension générative, elle ajoute quelques images au début ou à la fin d'un clip (malheureusement, Adobe n'a pas précisé combien d'images). L'extension générative n'a pas pour but de créer des scènes entières, mais plutôt d'ajouter des images intermédiaires à synchroniser avec une bande-son ou de conserver un plan pour lui donner un rythme supplémentaire, par exemple pour ajouter une tonalité émotionnelle.

Image: Adobe

Pour répondre à la peur de deepfakes Cela se produit inévitablement autour d'outils d'IA génératifs comme ceux-ci, Adobe affirme qu'il inclura les informations d'identification du contenu (métadonnées pour identifier les médias générés par l'IA) dans Premiere. Les informations d'identification du contenu, une norme de provenance des médias prise en charge par Adobe via sa Content Authenticity Initiative, étaient déjà présentes dans Photoshop et faisaient partie des modèles d'imagerie Firefly d'Adobe. Dans Premiere, ils indiqueront non seulement quel contenu a été généré par l’IA, mais également quel modèle d’IA a été utilisé pour le générer.

J'ai demandé à Adobe quelles données (images, vidéos, etc.) étaient utilisées pour entraîner le modèle. La société n’a pas précisé si ou comment (ou si) elle rémunère les contributeurs à l’ensemble de données.

La semaine dernière, Bloomberg, citant des sources proches du dossier, rapporté qu'Adobe paie jusqu'à 120 $ aux photographes et aux artistes sur sa plate-forme média stock, Adobe Stock, pour la soumission de courts clips vidéo afin de former son modèle de génération vidéo. Le paiement varie d'environ 2,62 dollars par minute de vidéo à environ 7,25 dollars par minute, selon la présentation, les images de meilleure qualité nécessitant des tarifs proportionnellement plus élevés.

Cela constituerait une rupture avec l'accord actuel d'Adobe avec les artistes et photographes d'Adobe Stock dont il utilise le travail pour former ses modèles de génération d'images. L'entreprise verse à ces contributeurs un bonus annuel, et non une redevance unique, en fonction du volume de contenu qu'ils ont en stock et de la manière dont ils sont utilisés, bien qu'il s'agisse d'un bonus soumis à une formule opaque et non garanti d'année en année.

Les rapports de Bloomberg, s'ils sont exacts, montrent une approche qui contraste fortement avec celle des concurrents de la vidéo générative d'IA comme OpenAI, qui a à plusieurs reprises Il a été dit qui a extrait des données de sites Web accessibles au public, y compris des vidéos YouTube, pour former ses modèles. Le PDG de YouTube, Neal Mohan, a récemment déclaré que l'utilisation de vidéos YouTube pour former le générateur de texte en vidéo d'OpenAI constituerait une violation des conditions d'utilisation de la plateforme, soulignant la faiblesse juridique de l'argument d'utilisation équitable de YouTube.

Les entreprises, dont OpenAI, sont être poursuivi en justice suite à des allégations selon lesquelles ils violeraient la loi sur le droit d'auteur en entraînant leur IA sur du contenu protégé par le droit d'auteur sans fournir de crédit ni payer les propriétaires. Adobe semble déterminé à éviter cette situation, à l'instar de ses concurrents parfois générateurs d'IA, Shutterstock et Getty Images (qui ont également des accords de licence pour les données de formation des modèles) et, avec sa politique de rémunération en matière de propriété intellectuelle, se positionne comme une option « sécurisée » vérifiable. pour les clients entreprises.

En ce qui concerne le paiement, Adobe ne dit pas combien il en coûtera aux clients pour utiliser les prochaines fonctionnalités de rendu vidéo de Premiere ; Les prix sont probablement encore en discussion, mais l'entreprise reveló que le système de paiement suivra le système de crédit génératif établi avec ses premiers modèles Firefly.

Pour les clients disposant d'un abonnement Adobe Creative Cloud payant, les crédits génératifs se renouvellent chaque mois, avec des allocations allant de 25 à 1000 XNUMX par mois, selon le forfait. Les charges de travail plus complexes (par exemple, les images générées à des résolutions plus élevées ou plusieurs générations d'images) nécessitent en règle générale plus de crédits.

La grande question qui se pose est la suivante : les fonctionnalités vidéo d'Adobe basées sur l'IA seront-elles vraiment des contributions de valeur différentielle selon son coût ?

Jusqu'à présent, les modèles d'imagerie Firefly ont été largement ridiculisé comme décevant et imparfait par rapport à Midjourney, au DALL-E 3 d'OpenAI et à d'autres outils concurrents. L’absence de calendrier de sortie sur le modèle vidéo n’incite pas à croire que le même sort sera évité. Le fait qu'Adobe ait refusé de montrer des démonstrations en direct d'ajout et de suppression d'objets et d'extension générative n'a pas non plus d'importance, insistant plutôt sur une vidéo préenregistrée.

Peut-être pour couvrir ses paris, Adobe affirme être en pourparlers avec des fournisseurs tiers sur l'intégration de ses modèles de génération vidéo dans Premiere, ainsi que sur l'optimisation d'outils tels que l'extension générative et bien plus encore.

L'un de ces fournisseurs est OpenAI.

Adobe affirme collaborer avec OpenAI pour trouver des moyens d'intégrer Sora dans le flux de travail Premiere. Un partenariat avec OpenAI a du sens compte tenu des capacités de la startup IA dans ses propositions à Hollywood récemment, il est révélateur que Mira Murati, CTO d'OpenAI, sera présente au Festival de Cannes cette année. Parmi les autres premiers partenaires figurent Pika, une startup qui crée des outils d'IA pour générer et éditer des vidéos, et Runway, qui a été l'un des premiers fournisseurs sur le marché à proposer un modèle vidéo génératif. .

Un porte-parole d'Adobe a déclaré que la société serait disposée à travailler avec d'autres à l'avenir.

Maintenant, pour être très clair, ces intégrations sont actuellement plus une expérience de réflexion qu’un produit fonctionnel. Adobe a souligné à plusieurs reprises qu'il s'agissait d'un « aperçu préliminaire » et d'une « recherche » plutôt que de quelque chose avec lequel les clients peuvent s'attendre à jouer dans un avenir proche.

Et c'est le ton général du produit vidéo génératif d'Adobe.

Adobe essaie clairement de signaler avec ces publicités qu'il pense à la vidéo générative, ne serait-ce qu'à titre préliminaire. Ce serait insensé de ne pas le faire : se laisser prendre au dépourvu dans la course à l'IA générative, c'est risquer de perdre une nouvelle source de revenus potentielle précieuse, en supposant que les paramètres économiques finissent par jouer en faveur d'Adobe. Après tout, les modèles d’IA coûtent cher à former, à exécuter et à distribuer.

Mais franchement, les concepts présentés ne sont pas très convaincants. Avec Sora dans son ensemble et sûrement d’autres innovations en route, l’entreprise a beaucoup à prouver.