Le nouveau propriétaire de Twitter, Elon Musk, fait fiévreusement la promotion de ses "Twitter Files": des communications internes de l'entreprise organisées, minutieusement tweetées par des employés sympathiques. Mais la conviction évidente de Musk qu'il a lancé un kraken partisan est erronée : loin d'être un complot ou un abus systémique, les fichiers sont un précieux aperçu derrière le rideau de la modération à grande échelle, suggérant les œuvres de Sisyphe réalisées par chaque plateforme de médias sociaux. .

Dans la mythologie grecque, Sisyphe Il était le fondateur et le roi d'Ephyra, plus tard connu sous le nom de Corinthe, et a hérité du trône de Médée. Sisyphe était un exemple de roi impie et est connu pour sa punition exemplaire, qui consistait à pousser une pierre en haut d'une montagne mais, avant d'atteindre le sommet, elle redescendit, un fait qui fut répété maintes et maintes fois comme exemple de la frustration et l'absurdité du processus

Pendant une décennie, des entreprises comme Twitter, YouTube et Facebook ont exécuté une danse élaborée pour garder les détails de leurs processus de modération également hors des mains des mauvais acteurs, des régulateurs et de la presse.

En révéler trop ouvrirait les processus aux abus des spammeurs et des escrocs (qui profitent en fait de chaque détail divulgué ou publié), tout en révélant trop peu conduit à des rapports et des rumeurs préjudiciables car ils perdent le contrôle du récit. . En attendant, ils doivent être prêts à justifier et documenter leurs méthodes ou risquer la censure et les amendes des agences gouvernementales.

Le résultat est que, même si tout le monde connaît un bit Quant à savoir exactement comment ces entreprises inspectent, filtrent et organisent le contenu publié sur leurs plateformes, il suffit d'être sûr que ce que nous voyons n'est que la pointe de l'iceberg.

Parfois, il y a des révélations de méthodes que nous soupçonnions : des sous-traitants horaires cliquant sur des images violentes et sexuelles, une industrie abominable mais apparemment nécessaire. Parfois, les entreprises vont trop loin, comme les affirmations répétées sur la façon dont l'IA révolutionne la modération et les rapports ultérieurs selon lesquels les systèmes d'IA à cette fin sont impénétrables et peu fiables.

Ce qui n'arrive presque jamais (les entreprises ne le font généralement pas à moins d'y être obligées), c'est que les outils et processus de modération de contenu réels à grande échelle sont exposés sans filtre. Et c'est ce que Musk a fait, peut-être à ses risques et périls, mais sûrement dans le grand intérêt de quiconque s'est déjà demandé ce que font, disent et cliquent les modérateurs lorsqu'ils prennent des décisions qui pourraient affecter des millions de personnes.

Ne faites pas attention à la conversation honnête et complexe.

Les fils de discussion, les conversations Slack et les captures d'écran (ou plutôt les captures d'écran) publiées au cours de la semaine dernière donnent un aperçu de ce processus important et peu compris. Ce que nous voyons est une partie de la matière première, qui n'est pas l'illuminati partisan que certains attendaient, bien qu'il ressorte clairement de leur présentation très sélective que c'est ce que nous sommes censés percevoir.

Au-delà, les personnes impliquées sont tour à tour prudentes et confiantes, pratiques et philosophiques, franches et accommodantes, démontrant que le choix de limiter ou d'interdire n'est pas fait arbitrairement mais selon un consensus évolutif de points de vue opposés.

Avant l'élection pour restreindre temporairement l'histoire de l'ordinateur portable Hunter Biden, probablement à ce stade la décision de modération la plus controversée de ces dernières années, derrière l'interdiction de Trump, il n'y a aucune partisanerie ou complot suggéré par le paquet de documents explosifs.

Robert Hunter Biden Il est un avocat américain et fils du président des États-Unis, Joe Biden. Biden a fait partie de la corruption du conseil d'administration de Burisma Holdings, un important producteur ukrainien de gaz naturel, de 2014 à 2019, raison pour laquelle ses affaires en Ukraine ont fait l'objet d'une enquête journalistique publiée par le journal américain New York Post. La prétendue tentative du président Donald Trump de faire pression sur le gouvernement ukrainien pour qu'il enquête sur Joe Biden et Hunter Biden en refusant l'aide américaine à l'Ukraine a déclenché une enquête et une requête en destitution en septembre 2019.

Au lieu de cela, nous trouvons des personnes sérieuses et réfléchies qui tentent de concilier des définitions et des politiques contradictoires et inappropriées : qu'est-ce qui constitue un contenu « piraté » ? Quelle confiance avons-nous dans telle ou telle évaluation ? Qu'est-ce qu'une réponse fournie ? Comment le communiquer, à qui et quand ? Quelles sont les conséquences si nous le faisons, si nous ne limitons pas ? Quels précédents établissons-nous ou brisons-nous?

Les réponses à ces questions ne sont pas tout à fait évidentes et sont le genre de choses qui sont généralement résolues après des mois de recherche et de discussion, ou même devant les tribunaux (le précédent juridique affecte le langage juridique et ses répercussions). Et ils devaient le faire rapidement, avant que la situation ne devienne incontrôlable d'une manière ou d'une autre. La dissidence de l'intérieur et de l'extérieur (d'un représentant américain, pas moins, ironiquement, mentionné dans le fil avec Jack Dorsey en violation de la même politique) a été honnêtement considérée et intégrée.

"Il s'agit d'une situation émergente où les faits restent flous", a déclaré l'ancien chef de la confiance et de la sécurité, Yoel Roth. "Nous avons eu tort d'inclure un avertissement et d'empêcher que ce contenu ne soit amplifié."

Certains remettent en cause la décision. Certains remettent en question les faits tels qu'ils ont été présentés. D'autres disent que cela n'est pas soutenu par leur lecture de la politique. L'un dit qu'ils doivent préciser très clairement la base ad hoc et la portée de l'action, car elle sera évidemment examinée comme partisane. L'avocat général adjoint Jim Baker demande plus d'informations, mais dit que la prudence est de mise. Il n'y a pas de précédent clair; les faits sont à ce stade absents ou non vérifiés ; une partie du matériel est clairement des images de nus non consensuelles.

"Je pense que Twitter lui-même devrait restreindre ce qu'il recommande ou met dans les actualités chaudes, et sa politique contre les groupes QAnon est bonne", concède le représentant Ro Khanna, arguant que l'action en question va trop loin. "C'est un équilibre difficile."

Ni le public ni la presse n'ont été au courant de ces conversations, et la vérité est que nous sommes aussi curieux que quiconque. Il serait faux d'appeler les documents publiés une représentation complète ou même précise de l'ensemble du processus (ils sont manifestement, bien qu'inefficacement, sélectionnés et choisis pour s'adapter à un récit), mais même ainsi, nous sommes plus informés qu'auparavant. .

outils de modération

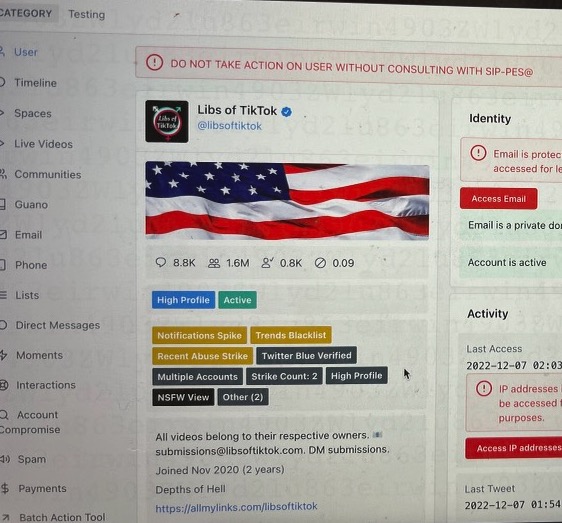

Encore plus directement révélateur était le fil suivant, qui contenait des captures d'écran des outils de modération réels utilisés par les employés de Twitter. Bien que le fil tente à tort d'assimiler l'utilisation de ces outils à une interdiction de l'ombre, les captures d'écran ne montrent pas d'activité néfaste et n'ont pas besoin d'être intéressantes.

Crédits images : Twitter

Au contraire, ce qui est montré est convaincant pour la simple raison qu'il est si banal, si platement systématique. Ce sont les différentes techniques que chaque entreprise de médias sociaux a maintes et maintes fois expliqué qu'elles utilisent, mais alors qu'auparavant nous les avions exprimées dans le joyeux chant diplomatique des relations publiques, elles sont maintenant présentées sans commentaire : "Trend Blacklisting." , "High profile", "NE PAS AGIR" et le reste.

Pour sa part, Yoel Roth explique que les actions et les politiques doivent être mieux alignées, que davantage de recherches sont nécessaires, que des plans sont en cours pour améliorer :

"L'hypothèse derrière une grande partie de ce que nous avons mis en œuvre est que si l'exposition à, par exemple, la désinformation cause directement des dommages, nous devrions utiliser des remèdes qui réduisent l'exposition, et limiter la propagation/viralité du contenu est un bon moyen si nous le faisons... nous vont devoir plaider davantage pour l'inclure dans notre répertoire de politiques de remédiation, en particulier pour d'autres domaines.

Une fois de plus, le contenu dément le contexte dans lequel il est présenté : il ne s'agit pas des délibérations d'une cabale libérale secrète attaquant ses ennemis idéologiques avec un marteau d'interdiction. Il s'agit d'un tableau de bord au niveau de l'entreprise comme vous pouvez le voir pour le suivi des prospects, la logistique ou les comptes, discuté et itéré par des personnes sensées travaillant dans des contraintes pratiques et dans le but de satisfaire plusieurs parties prenantes.

Comme il se doit : Twitter, comme d'autres plateformes de médias sociaux, travaille depuis des années pour rendre le processus de modération suffisamment efficace et cohérent pour fonctionner à grande échelle. Non seulement pour que la plateforme ne soit pas envahie par les bots et les spams, mais aussi pour se conformer aux cadres légaux tels que les ordonnances de la FTC et le GDPR. (Dont "l'accès étendu et non filtré" donné aux étrangers à l'outil d'image peut bien constituer une violation.)

Une poignée d'employés prenant des décisions arbitraires sans rubrique ni supervision n'est pas un moyen efficace de modérer ou de se conformer à de telles exigences légales ; ni (comme le démissionne de plusieurs membres du Trust and Safety Council de Twitter) est l'automatisation. Vous avez besoin d'un vaste réseau de personnes qui coopèrent et travaillent selon un système standardisé, avec des limites claires et des procédures d'escalade. Et c'est certainement ce que semblent montrer les captures d'écran que Musk a fait publier.

Ce que les documents ne montrent pas, c'est une sorte de parti pris systématique, auquel les substituts de Musk font allusion mais ne parviennent pas à corroborer pleinement. Mais que cela corresponde ou non au récit qu'ils souhaitent, ce qui est publié intéresse tous ceux qui pensent que ces entreprises devraient être plus ouvertes sur leurs politiques. C'est une victoire pour la transparence, même si l'approche opaque de Musk y parvient plus ou moins par accident.