Un umano l'ha scritto, o ChatGPT? Potrebbe essere difficile da sapere, forse troppo difficile, pensa il suo creatore OpenAI, motivo per cui sta lavorando a un modo per "filigranare" i contenuti generati dall'intelligenza artificiale.

In uno conferenza presso l'Università di Austin, il professore di informatica Scott Aaronson, attualmente ricercatore in visita presso OpenAI, ha rivelato che è in fase di sviluppo uno strumento per "filigranare statisticamente i risultati di un testo AI". Ogni volta che un sistema, ad esempio ChatGPT, genera del testo, lo strumento incorpora un "segnale segreto d'argento" che indica da dove proviene il testo.

l'ingegnere di OpenAIHendrik Kirchner ha costruito un prototipo funzionante, dice Aaronson, e la speranza è di incorporarlo nei futuri sistemi sviluppati da OpenAI.

"Vogliamo rendere molto più difficile prendere un output AI e farlo passare come proveniente da un essere umano", ha detto Aaronson nei suoi commenti. "Questo potrebbe essere utile per prevenire il plagio accademico, ovviamente, ma anche, per esempio, la generazione di propaganda di massa, sai, spammare ogni blog con commenti apparentemente sull'argomento a sostegno dell'invasione russa dell'Ucraina senza nemmeno un edificio pieno di troll a Mosca, o impersonare lo stile di scrittura di qualcuno per inquadrarlo".

Sfruttare la casualità

Perché la necessità di una filigrana? ChatGPT è un buon esempio. Il chatbot sviluppato da OpenAI ha preso d'assalto Internet, mostrando un'attitudine non solo a rispondere a domande impegnative, ma anche a scrivere poesie, risolvere enigmi di programmazione e diventare poetico su una serie di argomenti filosofici.

Sebbene ChatGPT sia molto divertente e davvero utile, il sistema solleva ovvie preoccupazioni etiche. Come molti dei sistemi di generazione di testo precedenti, ChatGPT poteva essere utilizzato per scrivere e-mail di phishing di alta qualità e malware dannosi o imbrogliare sui compiti scolastici. E come strumento di risposta alle domande, è di fatto incoerente, un difetto che ha portato alla programmazione del sito di domande e risposte Stack Overflow che vieta le risposte provenienti da ChatGPT fino a nuovo avviso.

Comprendere i fondamenti tecnici dello strumento filigrana OpenAI, è utile sapere perché sistemi come ChatGPT funzionano così bene. Questi sistemi interpretano il testo di input e output come stringhe di "token", che possono essere parole ma anche segni di punteggiatura e parti di parole. In sostanza, i sistemi generano costantemente una funzione matematica chiamata distribuzione di probabilità per decidere il prossimo token (es. parola) da generare, tenendo conto di tutti i token precedentemente emessi.

Nel caso di sistemi ospitati su OpenAI come ChatGPT, dopo che la distribuzione è stata creata, il server di chat OpenAI svolge il compito di campionare i token in base alla distribuzione. C'è una certa casualità in questa selezione; ecco perché lo stesso messaggio di testo può generare una risposta diversa.

Lo strumento filigrana OpenAI funge da "involucro" sui sistemi di generazione di testo esistenti, ha affermato Aaronson durante la conferenza, sfruttando una funzione crittografica che viene eseguita a livello di server per selezionare "pseudo-casualmente" il token successivo. In teoria, il testo generato dal sistema apparirebbe comunque casuale a te oa me, ma chiunque detenga la "chiave" della funzione crittografica potrebbe scoprire una filigrana.

“Empiricamente, poche centinaia di token sembrano essere sufficienti per ottenere un segnale ragionevole che sì, questo testo proviene da un sistema di intelligenza artificiale. In linea di principio, potresti persino prendere un lungo testo e isolare quali parti probabilmente provengono dal sistema di intelligenza artificiale e quali parti probabilmente no. disse Aaronson. "Lo strumento può eseguire la filigrana utilizzando una chiave segreta e può verificare la filigrana utilizzando la stessa chiave."

limitazioni fondamentali

La filigrana del testo generata dall'intelligenza artificiale non è un'idea nuova. I tentativi precedenti, per lo più basati su regole, si sono basati su tecniche come sostituzioni di sinonimi e modifiche di parole specifiche della sintassi. Ma fuori dal teorico il rapporto di indagine pubblicato dall'istituto tedesco CISPA lo scorso marzo, on OpenAI sembra essere uno dei primi approcci al problema basati sulle criptovalute.

Quando è stato contattato per un commento, Aaronson ha rifiutato di rivelare di più sul prototipo della filigrana, a parte il fatto che spera di essere coautore di un documento di ricerca nei prossimi mesi. OpenAI ha anche rifiutato, dicendo solo che il watermarking è tra le diverse "tecniche di provenienza" che sta esplorando per rilevare i risultati generati dall'intelligenza artificiale.

Tuttavia, accademici non affiliati ed esperti del settore condividevano opinioni contrastanti. Sottolineano che lo strumento è lato server, il che significa che non funzionerebbe necessariamente con tutti i sistemi di generazione di testo. E sostengono che sarebbe banale per gli avversari evitarlo.

"Penso che sarebbe abbastanza facile aggirarlo riformulando, usando sinonimi, ecc.", ha detto Srini Devadas, professore di informatica al MIT. "Questo è un po' un tiro alla fune."

Jack Hessel, un ricercatore presso l'Allen Institute for AI, ha osservato che sarebbe difficile prendere impronte digitali impercettibili del testo generato dall'IA perché ogni token è una scelta discreta. Un'impronta troppo evidente può comportare la scelta di parole strane che degradano la fluidità, mentre un'impronta troppo sottile lascerebbe spazio a dubbi durante la ricerca dell'impronta.

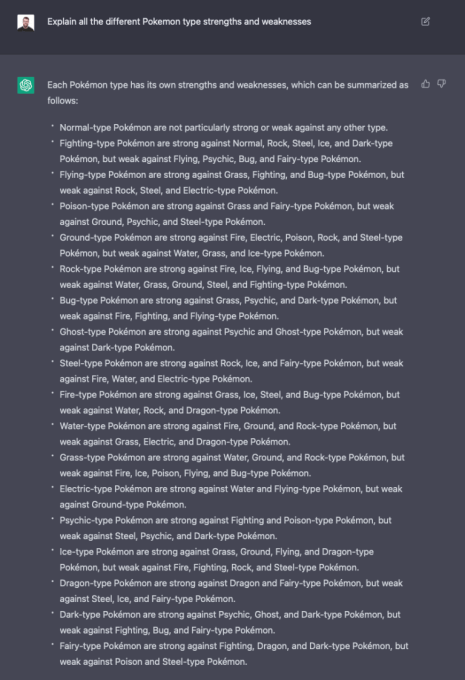

ChatGPT risponde a una domanda.

Yoav Shoham, co-fondatore e co-CEO di AI21 Labs, rivale di OpenAI, non ritiene che il watermarking statistico sia sufficiente per aiutare a identificare la fonte del testo generato dall'intelligenza artificiale. Chiede un approccio "più completo" che includa filigrane differenziali, in cui diverse parti del testo sono contrassegnate in modo diverso, e sistemi di intelligenza artificiale che citano in modo più accurato fonti di testo fattuale.

Questa specifica tecnica di watermarking richiede anche molta fiducia e potere OpenAIsottolineano gli esperti.

"Un'impronta digitale ideale non sarebbe percepibile da un lettore umano e consentirebbe un rilevamento altamente affidabile", ha affermato Hessel via e-mail. "A seconda di come è impostato, potrebbe essere quello OpenAI è l'unica parte in grado di fornire tale rilevamento con sicurezza grazie al modo in cui funziona il processo di "firma".

Nella sua conferenza, Aaronson ha riconosciuto che lo schema funzionerebbe davvero solo in un mondo in cui piacciono le aziende OpenAI sono in prima linea nell'espansione dei sistemi all'avanguardia e concordano tutti di essere attori responsabili. Anche se OpenAI condiviso lo strumento di watermarking con altri fornitori di sistemi di generazione di testo, come Cohere e AI21Labs, ciò non impedirebbe ad altri di scegliere di non utilizzarlo.

"Se diventa un gioco tutti contro tutti, molte delle misure di sicurezza diventano più difficili e potrebbero persino essere impossibili, almeno senza la regolamentazione del governo", ha detto Aaronson. "In un mondo in cui chiunque può costruire il proprio modello di testo che sia altrettanto valido di ChatGPT, per esempio... Cosa si potrebbe fare lì?"

Ecco come si svolge nel regno del testo in immagine. A differenza di OpenAI, il cui sistema di imaging DALL-E 2 è disponibile solo tramite un'API, Stability AI ha aperto la sua tecnologia text-to-image (chiamata Stable Diffusion). Mentre DALL-E 2 ha una serie di filtri a livello di API per impedire la generazione di immagini problematiche (oltre alle filigrane sulle immagini che genera), l'open source Stable Diffusion no. I cattivi attori l'hanno usato per creare porno falso, tra le altre tossicità.

Da parte sua, Aaronson è ottimista. Alla conferenza, ha espresso la convinzione che, se OpenAI può dimostrare che le filigrane funzionano e non influiscono sulla qualità del testo generato, ha il potenziale per diventare uno standard del settore.

Non tutti sono d'accordo. Come sottolinea Devadas, lo strumento richiede una chiave, il che significa che non può essere completamente open source, il che potrebbe limitarne l'adozione alle organizzazioni che accettano di collaborare con esso. OpenAI. (Se la chiave fosse resa pubblica, chiunque potrebbe indovinare lo schema dietro le filigrane, vanificando il loro scopo.)

Ma potrebbe non essere così inverosimile. Un rappresentante di Quora ha affermato che la società sarebbe interessata a utilizzare un tale sistema e che probabilmente non sarebbe l'unico.

"Potresti preoccuparti che l'intera faccenda di cercare di essere sicuri e responsabili quando si ridimensiona l'IA... non appena danneggerà seriamente i profitti di Google, Meta, Alibaba e gli altri principali attori, molto andrà fuori dalla finestra, disse Aaronson. “D'altra parte, abbiamo visto negli ultimi 30 anni che le grandi società di Internet possono concordare alcuni standard minimi, sia per paura di essere citati in giudizio, per il desiderio di essere visti come un giocatore responsabile, o per qualsiasi altro motivo . motivo".

Post molto carino. Mi sono appena imbattuto nel tuo blog e volevo dire che mi è davvero piaciuto sfogliare i tuoi post. In ogni caso mi iscriverò al tuo feed e spero che tu scriva presto di nuovo!