Der neue Besitzer von Twitter, Elon Musk, wirbt fieberhaft für seine „Twitter Files“: kuratierte interne Unternehmenskommunikation, akribisch getwittert von sympathischen Angestellten. Aber Musks offensichtliche Überzeugung, dass er einen parteiischen Kraken ins Leben gerufen hat, ist fehlgeleitet: Weit davon entfernt, eine Verschwörung oder systematischen Missbrauch zu sein, sind die Dateien ein wertvoller Blick hinter den Vorhang einer groß angelegten Moderation, die auf die Werke von Sisyphos hindeutet, die von jeder Social-Media-Plattform erstellt wurden .

In der griechischen Mythologie Sisyphus Er war der Gründer und König von Ephyra, später bekannt als Korinth, und erbte den Thron von Medea. Sisyphus war ein Beispiel für einen gottlosen König und ist bekannt für seine exemplarische Bestrafung, bei der er einen Stein einen Berg hinaufschob, aber bevor er den Gipfel erreichte, rollte er wieder herunter, eine Tatsache, die immer wieder als Beispiel wiederholt wurde die Frustration und Absurdität des Prozesses

Seit einem Jahrzehnt führen Unternehmen wie Twitter, YouTube und Facebook einen aufwändigen Tanz auf, um die Details ihrer Moderationsprozesse gleichermaßen aus den Händen von schlechten Schauspielern, Aufsichtsbehörden und der Presse zu halten.

Zu viel preiszugeben würde Prozesse für Missbrauch durch Spammer und Betrüger öffnen (die tatsächlich jedes durchgesickerte oder veröffentlichte Detail ausnutzen), während zu wenig preiszugeben zu schädlichen Berichten und Gerüchten führt, da sie die Kontrolle über die Erzählung verlieren. In der Zwischenzeit müssen sie bereit sein, ihre Methoden zu rechtfertigen und zu dokumentieren, oder sie riskieren Zensur und Bußgelder von Regierungsbehörden.

Das Ergebnis ist, dass, obwohl jeder weiß, a Bit Was genau diese Unternehmen die auf ihren Plattformen geposteten Inhalte prüfen, filtern und organisieren, reicht aus, um sicher zu sein, dass das, was wir sehen, nur die Spitze des Eisbergs ist.

Manchmal gibt es Enthüllungen von Methoden, die wir vermutet haben: stündliche Auftragnehmer, die auf gewalttätige und sexuelle Bilder klicken, eine abscheuliche, aber scheinbar notwendige Industrie. Manchmal gehen Unternehmen über Bord, wie zum Beispiel wiederholte Behauptungen, wie KI die Moderation revolutioniert, und nachfolgende Berichte, dass KI-Systeme für diesen Zweck undurchschaubar und unzuverlässig sind.

Was fast nie passiert (Unternehmen tun dies normalerweise nicht, es sei denn, sie werden dazu gezwungen), ist, dass die eigentlichen Tools und Prozesse zur Moderation von Inhalten ohne Filter offengelegt werden. Und das hat Musk getan, vielleicht auf eigene Gefahr, aber sicherlich zum großen Interesse aller, die sich jemals gefragt haben, was Moderatoren tun, sagen und klicken, wenn sie Entscheidungen treffen, die Millionen betreffen könnten.

Achten Sie nicht auf das ehrliche und komplexe Gespräch.

Die E-Mail-Threads, Slack-Konversationen und Screenshots (oder vielmehr Screenshots), die in der vergangenen Woche gepostet wurden, geben einen Einblick in diesen wichtigen und wenig verstandenen Prozess. Was wir sehen, ist ein Teil des Rohmaterials, das nicht die parteiischen Illuminaten sind, die einige erwartet haben, obwohl aus ihrer höchst selektiven Präsentation klar wird, dass wir genau das wahrnehmen sollen.

Darüber hinaus sind die beteiligten Personen abwechselnd vorsichtig und selbstbewusst, praktisch und philosophisch, offen und entgegenkommend und zeigen, dass die Entscheidung, einzuschränken oder zu verbieten, nicht willkürlich getroffen wird, sondern einem sich entwickelnden Konsens gegensätzlicher Standpunkte entspricht.

Vor der Wahl zur vorübergehenden Einschränkung der Laptop-Story von Hunter Biden, der wohl zu diesem Zeitpunkt wohl umstrittensten Moderationsentscheidung der letzten Jahre, hinter dem Trump-Verbot, lässt sich durch das Paket der Dokumentenbombe keine Parteinahme oder Verschwörung anklingen.

Robert Hunter Biden Er ist ein amerikanischer Anwalt und Sohn des Präsidenten der Vereinigten Staaten, Joe Biden. Biden war von 2014 bis 2019 Teil der Korruption des Vorstands von Burisma Holdings, einem großen ukrainischen Erdgasproduzenten, weshalb sein Geschäft in der Ukraine Gegenstand einer journalistischen Untersuchung war, die von der amerikanischen Zeitung New York Post veröffentlicht wurde. Der angebliche Versuch von Präsident Donald Trump, die ukrainische Regierung unter Druck zu setzen, gegen Joe Biden und Hunter Biden zu ermitteln, indem er der Ukraine die US-Hilfe vorenthielt, löste im September 2019 eine Amtsenthebungsuntersuchung und einen Amtsenthebungsantrag aus.

Stattdessen finden wir ernsthafte und nachdenkliche Menschen, die versuchen, widersprüchliche und unangemessene Definitionen und Richtlinien in Einklang zu bringen: Was macht „gehacktes“ Material aus? Welches Vertrauen haben wir in diese oder jene Einschätzung? Was ist eine bereitgestellte Antwort? Wie sollen wir es kommunizieren, an wen und wann? Was sind die Folgen, wenn wir es tun, wenn wir nicht einschränken? Welche Präzedenzfälle schaffen oder brechen wir?

Die Antworten auf diese Fragen sind nicht ganz offensichtlich und werden normalerweise in monatelangen Recherchen und Diskussionen oder sogar vor Gericht gelöst (Präzedenzfälle wirken sich auf die Rechtssprache und die Auswirkungen aus). Und sie mussten es schnell tun, bevor die Situation auf die eine oder andere Weise außer Kontrolle geriet. Dissens von innen und außen (von einem US-Vertreter, nicht weniger, ironischerweise erwähnt im Thread zusammen mit Jack Dorsey unter Verletzung derselben Richtlinie) wurde ehrlich berücksichtigt und integriert.

„Dies ist eine sich abzeichnende Situation, in der die Fakten unklar bleiben“, sagte der ehemalige Chef von Trust and Security, Yoel Roth. „Wir haben uns geirrt, eine Warnung aufzunehmen und zu verhindern, dass dieser Inhalt verstärkt wird.“

Manche hinterfragen die Entscheidung. Einige stellen die Tatsachen, wie sie präsentiert wurden, in Frage. Andere sagen, dass dies durch ihre Lektüre der Richtlinie nicht unterstützt wird. Einer sagt, sie müssten die Ad-hoc-Basis und den Umfang der Aktion sehr deutlich machen, da sie offensichtlich als parteiisch geprüft wird. Deputy General Counsel Jim Baker bittet um weitere Informationen, sagt aber, dass Vorsicht geboten ist. Es gibt keinen klaren Präzedenzfall; die Tatsachen sind zu diesem Zeitpunkt nicht vorhanden oder unbestätigt; Bei einigen der Materialien handelt es sich eindeutig um nicht einvernehmliche Nacktbilder.

„Ich denke, Twitter selbst sollte einschränken, was es empfiehlt oder in heiße Nachrichten bringt, und seine Politik gegenüber QAnon-Gruppen ist gut“, räumt der Vertreter Ro Khanna ein und argumentiert, dass die fragliche Aktion einen Schritt zu weit geht. "Es ist eine schwierige Balance."

Weder die Öffentlichkeit noch die Presse haben von diesen Gesprächen Kenntnis genommen, und die Wahrheit ist, dass wir genauso neugierig sind wie jeder andere. Es wäre falsch, die veröffentlichten Materialien als vollständige oder sogar genaue Darstellung des gesamten Prozesses zu bezeichnen (sie sind offensichtlich, wenn auch ineffektiv, ausgewählt und ausgewählt, um zu einer Erzählung zu passen), aber trotzdem sind wir besser informiert als zuvor. .

Moderationswerkzeuge

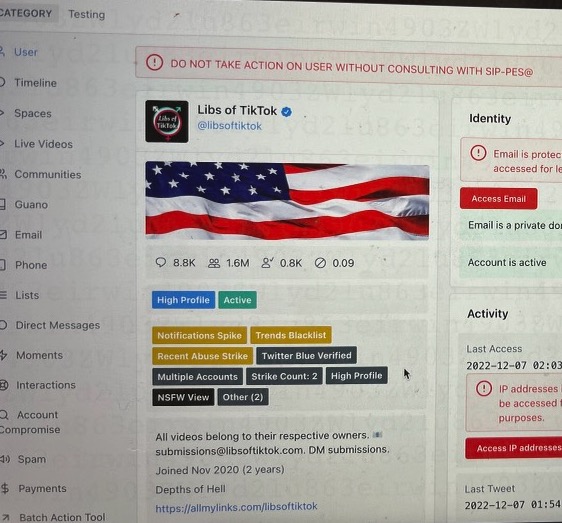

Noch direkter aufschlussreich war der folgende Thread, der Screenshots von tatsächlichen Moderationstools enthielt, die von Twitter-Mitarbeitern verwendet wurden. Während der Thread fälschlicherweise versucht, die Verwendung dieser Tools mit einem Schattenverbot gleichzusetzen, zeigen die Screenshots keine schändlichen Aktivitäten und müssen es auch nicht sein, um interessant zu sein.

Bildnachweis: Twitter

Im Gegenteil, das Gezeigte überzeugt gerade deshalb, weil es so banal, so nüchtern systematisch ist. Dies sind die verschiedenen Techniken, die jedes Social-Media-Unternehmen immer wieder erklärt hat, die sie verwenden, aber wo wir sie zuvor in den fröhlichen diplomatischen Gesang der Öffentlichkeitsarbeit gehüllt hatten, werden sie jetzt kommentarlos präsentiert: „Trend Blacklisting“. „High Profile“, „DO NOT ACT“ und der Rest.

Yoel Roth seinerseits erklärt, dass Maßnahmen und Strategien besser aufeinander abgestimmt werden müssen, dass mehr Forschung erforderlich ist und dass Pläne zur Verbesserung gemacht werden:

„Die Annahme hinter vielem, was wir implementiert haben, ist, dass wir, wenn beispielsweise die Exposition gegenüber Fehlinformationen direkt Schaden verursacht, Mittel anwenden sollten, die die Exposition verringern, und die Begrenzung der Verbreitung/Viralität von Inhalten ein guter Weg ist, wenn wir dies tun … wir müssen wir stärker dafür plädieren, dies in unser Repertoire an politischen Abhilfemaßnahmen aufzunehmen, insbesondere für andere Bereiche.“

Wieder einmal täuscht der Inhalt über den Kontext hinweg, in dem er präsentiert wird: Dies sind nicht die Überlegungen einer geheimen liberalen Kabale, die ihre ideologischen Feinde mit einem Verbotshammer angreift. Es ist ein Dashboard auf Unternehmensebene, wie Sie es vielleicht für Lead-Tracking, Logistik oder Konten sehen, das von sachlichen Leuten diskutiert und iteriert wird, die innerhalb praktischer Einschränkungen und mit dem Ziel arbeiten, mehrere Stakeholder zufrieden zu stellen.

Wie es sein sollte: Twitter arbeitet wie andere Social-Media-Plattformen seit Jahren daran, den Moderationsprozess effizient und konsistent genug zu gestalten, um in großem Umfang zu funktionieren. Nicht nur, damit die Plattform nicht von Bots und Spam überfallen wird, sondern auch, um rechtliche Rahmenbedingungen wie die Anordnungen der FTC und die DSGVO einzuhalten. (Davon kann der „umfassende und ungefilterte Zugriff“, der Außenstehenden auf das Bildtool gewährt wird, durchaus eine Verletzung darstellen.)

Eine Handvoll Mitarbeiter, die willkürliche Entscheidungen ohne Rubrik oder Aufsicht treffen, ist keine Möglichkeit, solche gesetzlichen Anforderungen effektiv zu moderieren oder einzuhalten; auch nicht (wie die renuncia von mehreren im Trust and Safety Council von Twitter) ist Automatisierung. Sie brauchen ein großes Netzwerk von Menschen, die kooperieren und nach einem standardisierten System arbeiten, mit klaren Grenzen und Eskalationsverfahren. Und das scheinen die Screenshots zu zeigen, die Musk zur Veröffentlichung veranlasst hat.

Was die Dokumente nicht zeigen, ist jede Art von systematischer Voreingenommenheit, die Musks Stellvertreter zwar andeuten, aber nicht vollständig bestätigen. Aber unabhängig davon, ob es zu der von ihnen gewünschten Darstellung passt oder nicht, ist das Gepostete für jeden von Interesse, der der Meinung ist, dass diese Unternehmen in Bezug auf ihre Richtlinien offener sein sollten. Das ist ein Gewinn für die Transparenz, auch wenn Musks undurchsichtiger Ansatz mehr oder weniger zufällig dazu führt.