In un post pubblicato la scorsa settimana, meta domanda, "Dove sono i robot?" La risposta è semplice. Loro sono qui. Devi solo sapere dove cercare. Lasciando da parte i discorsi sulle auto e sull'assistenza alla guida e concentrandoci sulle cose che tendiamo tutti a concordare sono i robot. Per cominciare, la consegna di Amazon non ti arriva senza l'assistenza robotica.

Una domanda più pertinente sarebbe: perché non ci sono più robot? E più specificamente, perché non ci sono più robot in casa mia in questo momento? È una domanda complessa con molte sfumature, molte delle quali si riducono allo stato attuale delle limitazioni hardware attorno al concetto di robot "general purpose". Roomba è un robot. Ci sono molti Roomba nel mondo, e questo è in gran parte dovuto al fatto che Roomba fa una cosa giusta (un decennio in più di ricerca e sviluppo ha contribuito a spostare le cose da uno stato "abbastanza buono").

Non è tanto che la premessa della domanda sia errata, è più una questione di riformularla leggermente. "Perché non ci sono più robot?" è una domanda perfettamente valida per qualcuno che non è un robotista.

La versione Meta è basata su software, e questo è abbastanza giusto. Negli ultimi anni, c'è stata un'esplosione di startup che affrontano diverse categorie importanti, come apprendimento robotico, implementazione/gestione e soluzioni no-code e low-code. Menzione speciale ai quasi due decenni di ricerca e sviluppo che hanno portato alla creazione, manutenzione e miglioramento del ROS (Robot Operating System, open source). Opportunamente, i leader di lunga data Open Robotics sono stati acquisiti da Alphabet, che ha svolto il proprio lavoro nella categoria attraverso gli sforzi locali Intrinsic e Everyday Robots (sebbene siano stati colpiti in modo sproporzionato dalla riduzione delle risorse su tutta la linea).

Senza dubbio Meta/Facebook ha la sua quota di progetti skunkworks che saltano fuori di tanto in tanto. Finora non ho visto nulla che suggerisca che siano all'altezza di ciò che Alphabet/Google ha esplorato nel corso degli anni, ma è sempre interessante vedere alcuni di questi progetti incombere. In un annuncio che sospetto fortemente sia correlato alla proliferazione di dibattiti sull'IA generativa, il gigante dei social media ha condiviso quelli che definisce "due importanti progressi verso agenti di intelligenza artificiale incorporati generici in grado di sfidare le capacità sensomotorie".

Citando direttamente qui:

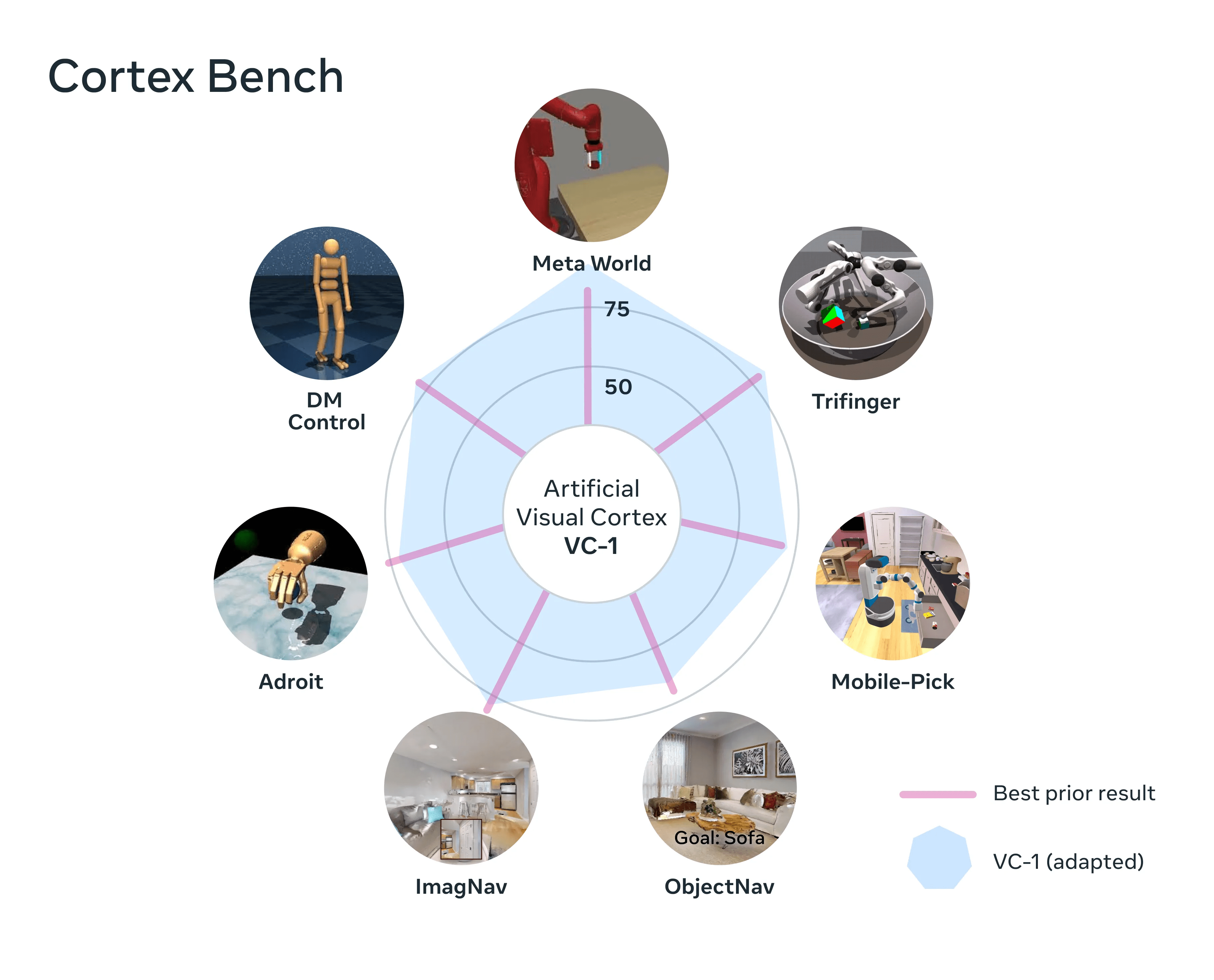

Una corteccia visiva artificiale, Cortex Bench (denominata VC-1): un modello di percezione unico che, per la prima volta, supporta un'ampia gamma di abilità, ambienti e incarnazioni sensomotorie. VC-1 è addestrato su video di persone che svolgono attività quotidiane dall'innovativo set di dati Ego4D creato da Meta AI e partner accademici. E VC-1 corrisponde o supera i risultati più noti su 17 diversi compiti sensomotori in ambienti virtuali.

Un nuovo approccio chiamato coordinazione adattiva delle abilità (sensomotoria) (ASC), che raggiunge prestazioni quasi perfette (successo del 98%) nell'impegnativo compito della manipolazione mobile robotica (navigare verso un oggetto, raccoglierlo, spostarsi in un'altra posizione, posizionare il oggetto, ripetizione) in ambienti fisici.

Immagine: Meta

Ricerche interessanti, certo, ed eccitanti per approfondire potenzialmente alcune di queste cose. La frase "scopo generale" viene usata molto in questi giorni. È un argomento di conversazione perennemente interessante nella robotica, ma c'è stata una massiccia proliferazione di robot umanoidi generici che sono usciti dalla falegnameria sulla scia dell'introduzione del robot Tesla. Per anni, le persone hanno detto cose come "Dì quello che vuoi su Musk, ma Tesla ha suscitato un rinnovato interesse per i veicoli elettrici" ed è praticamente quello che provo per Optimus in questo momento. Ha svolto un'importante duplice funzione rinnovando la discussione sul fattore di forma, fornendo al contempo un quadro chiaro a cui puntare quando si spiega quanto sia difficile. È possibile aumentare drasticamente le aspettative del pubblico e moderarle allo stesso tempo?

Ancora una volta, quelle conversazioni combaciano perfettamente con tutti questi progressi GPT. È tutto molto impressionante, ma Rodney Brooks ha sollevato il pericolo di mescolare le cose abbastanza bene su questo alcune settimane fa: “Penso che le persone siano troppo ottimiste. Stanno confondendo la prestazione con la competenza. Vedi una buona prestazione in un essere umano, puoi dire in cosa è competente. Siamo abbastanza bravi a modellare le persone, ma quegli stessi modelli non si applicano. Vedi grandi prestazioni da uno di questi sistemi, ma non ti dice come si comporterà nello spazio adiacente o con dati diversi".

Immagine: covariante

Ovviamente, questo non preclude di chiedere alla maggior parte delle persone di entrare ProMat sulla sua opinione sul ruolo futuro dell'IA generativa nella robotica. Le risposte sono state di ampia portata: alcuni scrollano le spalle, altri vedono un ruolo molto irreggimentato per la tecnologia, e altri ancora sono estremamente ottimisti su ciò che tutto ciò significherà per il futuro. Peter Chen, CEO di Covariant (che ha appena raccolto 75 milioni di dollari), ha offerto un contesto interessante quando si tratta di IA pervasiva:

Prima del recente ChatGPT, c'erano molte IA per l'elaborazione del linguaggio naturale. Ricerca, traduzione, rilevamento del sentiment, rilevamento dello spam: c'era un sacco di intelligenza artificiale del linguaggio naturale là fuori. L'approccio prima di GPT è, per ogni caso d'uso, addestrare un'IA specifica, utilizzando un sottoinsieme più piccolo di dati.

Guardando ora i risultati, GPT rimuove il campo di traduzione e non è nemmeno in grado di tradurre. Fondamentalmente, l'approccio del modello di base è, invece di utilizzare piccole quantità di dati specifici per una situazione o addestrare un modello specifico per una circostanza, addestriamo un modello di base generalizzato di grandi dimensioni con molti più dati, quindi l'IA è più pervasiva .

Naturalmente, Covariant è attualmente molto concentrato sul pick and place. Francamente, è una sfida abbastanza grande da tenerli occupati per molto tempo. Ma una delle promesse offerte da sistemi come questo è la formazione nel mondo reale. Le aziende che hanno robot reali che svolgono lavori reali nel mondo reale stanno costruendo database e modelli estremamente potenti di come le macchine interagiscono con il mondo che le circonda.

Non è difficile vedere quanti degli elementi costitutivi apparentemente disparati rafforzati da ricercatori e aziende potrebbero un giorno unirsi per creare un sistema veramente generico. Quando l'hardware e l'intelligenza artificiale saranno a quel livello, ci sarà una miniera apparentemente infinita di dati sul campo con cui addestrarli.

Al momento, l'approccio della piattaforma ha molto senso. Con Spot, ad esempio, Boston Dynamics sta effettivamente vendendo ai clienti un modello di iPhone. Innanzitutto, produce la prima generazione di un hardware impressionante. Offre quindi un SDK alle parti interessate. Se le cose vanno come previsto, all'improvviso hai questo prodotto che fa cose che il tuo team non avrebbe mai immaginato. Supponendo che ciò non implichi il montaggio di una pistola sul retro del prodotto (secondo le linee guida di BD), questa è una proposta entusiasmante.

Immagine: 1X

È troppo presto per dire qualcosa di definitivo in merito Il robot NEO di 1X Technologies, al di là del fatto che l'azienda chiaramente spera di vivere proprio in quello incrocio tra robotica e IA generativa. Hai sicuramente un potente alleato in OpenAI. Lo Startup Fund del gigante generativo dell'IA ha condotto un round da 23,5 milioni di dollari, che comprendeva anche Tiger Global, tra gli altri.

Dice il fondatore e CEO di 1X Bernt Øivind Børnich, “1X è lieta che OpenAI guidi questo round perché siamo allineati sulle nostre missioni: integrare con attenzione la tecnologia emergente nella vita quotidiana delle persone. Con il supporto dei nostri investitori, continueremo a fare progressi significativi nel campo della robotica e ad aumentare il mercato del lavoro globale".

Una nota interessante al riguardo (almeno per me) è che 1X esiste da un minuto. L'azienda norvegese era conosciuta come Halodi fino alla sua epoca molto recente (esattamente un mese fa) conciso rebranding. Devi solo tornare indietro di un anno o due per vedere gli inizi assumere il fattore di forma umanoide che l'azienda stava sviluppando. per la ristorazione. La tecnologia sembra decisamente più sofisticata rispetto alla sua controparte del 2021, ma la base su ruote rivela fino a che punto spingersi per arrivare a una versione del robot che vediamo se è renderizzata.

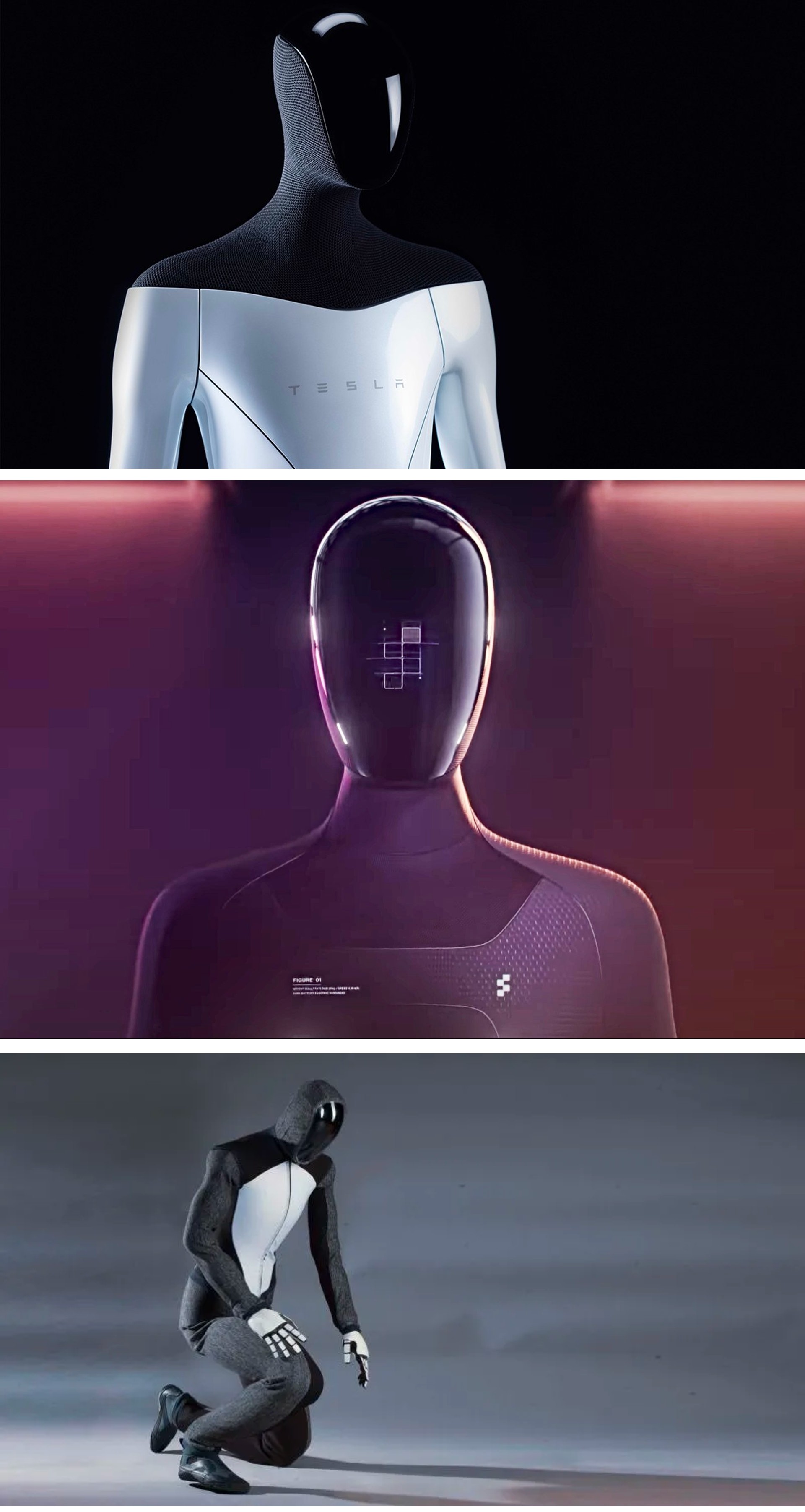

Immagini: Tesla/figura/IX

Dall'alto verso il basso, questi sono i rendering di Tesla Optimus, Figure 01 e 1X Neo. Non sono copie dirette, ovviamente, ma di certo sembrano cugini. Neo è quello che insiste per indossare una felpa con cappuccio, anche nelle occasioni formali.

Immagine: MITCSAIL

In parallelo ci sono interessanti progetti di ricerca. Uno è del MIT. Quando ci pensi davvero, giocare a calcio è un ottimo modo per testare la tua locomozione. C'è un motivo per cui la Robocup esiste da quasi 20 anni. Tuttavia, nel caso di Dribblebot, la sfida è il terreno irregolare, comprese cose come erba, fango e sabbia.

Dice il professore del MIT Pulkit Agrawal:

Se ti guardi intorno oggi, la maggior parte dei robot ha le ruote. Ma immagina che ci sia uno scenario disastroso, un'alluvione o un terremoto, e vogliamo che i robot aiutino gli umani nel processo di ricerca e salvataggio. Abbiamo bisogno che le macchine attraversino terreni che non sono pianeggianti e i robot su ruote non possono attraversare tali paesaggi. L'obiettivo dello studio dei robot con le gambe è quello di entrare in regni oltre la portata degli attuali sistemi robotici.

Immagine: Università della California Los Angeles

Un altro progetto di ricerca è della UCLA Samueli School of Engineering, che ha recentemente pubblicato scoperte dal suo lavoro sui robot origami. Origami MechanoBots, o "OrigaMech", si basano su sensori incorporati nei loro sottili blocchi di poliestere. L'investigatore principale Ankur Mehta ha alcuni piani piuttosto remoti per la tecnologia.

"Questi tipi di scenari pericolosi o imprevedibili, come durante un disastro naturale o provocato dall'uomo, potrebbero essere i luoghi in cui i robot origami si sono rivelati particolarmente utili", ha affermato in un post. “I robot potrebbero essere progettati per funzioni speciali e prodotti su richiesta molto rapidamente. Inoltre, sebbene sia molto lontano, potrebbero esserci ambienti su altri pianeti in cui i robot esploratori immuni a tali scenari sarebbero altamente desiderabili".