Inteligencia Artificial

El pasado mes de junio, apenas Meses después del lanzamiento de ChatGPT de OpenAI, un par de abogados de la ciudad de Nueva York utilizaron la herramienta de manera infame. escribir un resumen muy pobre. La AI citó casos falsos, lo que provocó un revuelo, un juez enojado y dos abogados muy avergonzados. Fue una prueba de que, si bien los bots como ChatGPT pueden ser útiles, realmente hay que comprobar su trabajo cuidadosamente, especialmente en un contexto legal.

El caso no se le escapó a la gente de LexisNexis, una empresa de software legal que ofrece herramientas para ayudar a los abogados a encontrar la jurisprudencia adecuada para presentar sus argumentos legales. La compañía ve el potencial de la IA para ayudar a reducir gran parte del trabajo legal mundano que realiza cada abogado, pero también reconoce estos problemas muy reales a medida que comienza su viaje generativo de IA.

Jeff Reihl, director de tecnología de LexisNexis, comprende el valor de la IA. De hecho, su empresa lleva algún tiempo incorporando la tecnología a su plataforma. Pero poder agregar una funcionalidad similar a ChatGPT a su caja de herramientas legales ayudaría a los abogados a trabajar de manera más eficiente: ayudaría con la redacción breve y encontrar citaciones más rápido.

“Nosotros, como organización, hemos estado trabajando con tecnologías de inteligencia artificial durante varios años. Creo que lo que es realmente diferente ahora desde que salió ChatGPT en noviembre es la oportunidad de generar texto y los aspectos conversacionales que vienen con esta tecnología”, dijo Reihl.

Y si bien ve que esto podría ser una capa poderosa además de la familia de software legal LexisNexis, también conlleva riesgos. “Con la IA generativa, creo que estamos viendo, realmente, el poder y las limitaciones de esa tecnología, lo que puede y no puede hacer bien”, dijo. “Y aquí es donde pensamos que reuniendo nuestras capacidades que tenemos y los datos que tenemos, junto con las capacidades que tienen estos grandes modelos de lenguaje, podemos hacer algo que sea fundamentalmente transformador para la industria legal”.

La encuesta dice …

LexisNexis encuestó recientemente a 1.000 abogados sobre el potencial de la IA generativa para su profesión. Los datos mostraron que la gente era en su mayoría positiva, pero también reveló que los abogados reconocen las debilidades de la tecnología, y eso está atenuando parte del entusiasmo al respecto.

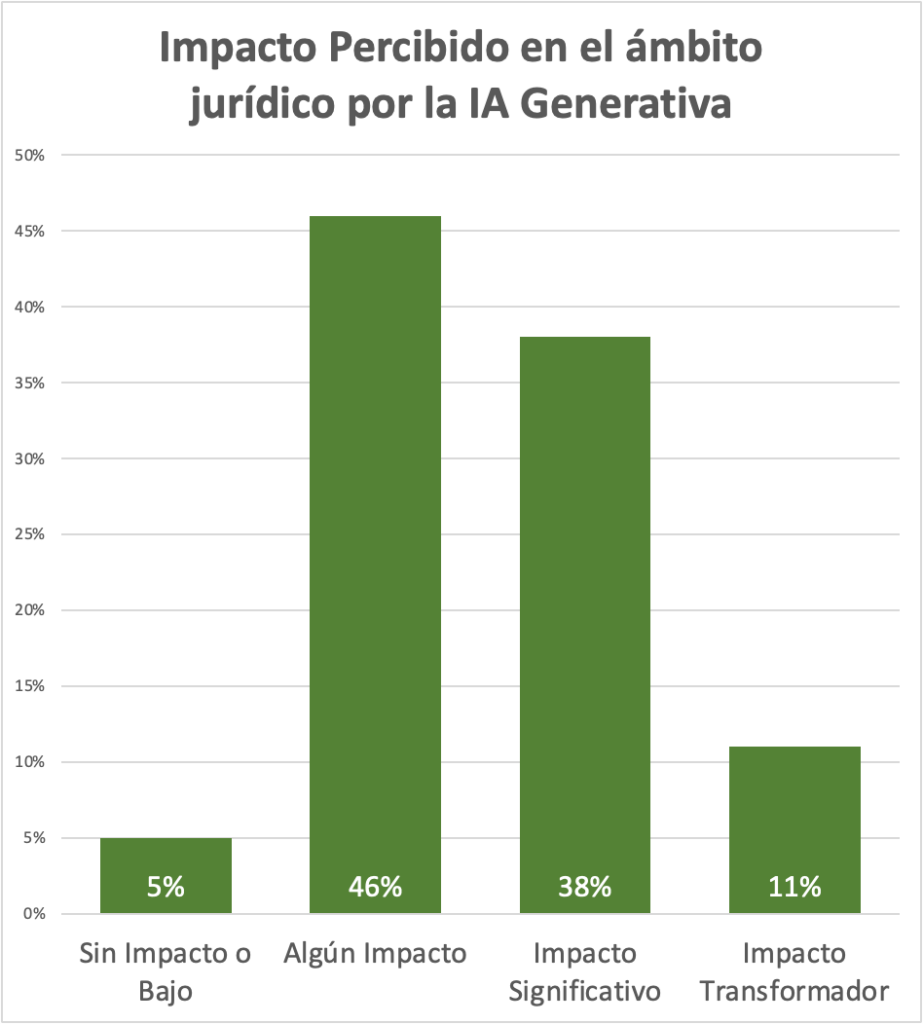

A modo de ejemplo, cuando se les preguntó sobre el impacto percibido de la IA generativa en su profesión, el 46% respondió con una respuesta bastante tibia: “algún impacto”. Pero la siguiente respuesta más alta, con un 38%, fue un “impacto significativo”. Ahora bien, estas son opiniones subjetivas de cómo podrían usar una tecnología que aún se está evaluando y que está siendo exagerada con mucha publicidad, pero los resultados muestran que la mayoría de los abogados encuestados al menos ven el potencial de la IA generativa para ayudar. ellos hacen su trabajo.

Hay que tener en cuenta que siempre hay lugar para el sesgo en términos de los tipos de preguntas y las interpretaciones de los datos cuando se trata de encuestas realizadas por proveedores, pero los datos son útiles para ver en términos generales cómo piensan los abogados sobre la tecnología.

Pregunta de la encuesta de abogados de LexisNexis que analiza el impacto percibido de la IA en la práctica del derecho.

Créditos de imagen: LexisNexis

Uno de los problemas clave aquí es confiar en la información que obtiene del bot, y LexisNexis está trabajando en varias formas de generar confianza en los resultados de los usuarios.

Abordar los problemas conocidos de la IA

El problema de la confianza es uno que todos los usuarios de IA generativa van a encontrar, al menos por el momento, pero Reihl dice que su empresa reconoce lo que está en juego para sus clientes.

“Dado su papel y lo que hacen como profesión, lo que hacen tiene que ser 100% preciso”, dijo. “Deben asegurarse de que, si citan un caso, en realidad sigue siendo una buena ley y representa a sus clientes de la manera correcta”.

“Si no representan a sus clientes de la mejor manera, podrían ser inhabilitados. Y tenemos un historial de poder brindar información confiable a nuestros clientes”.

Sebastian Berns, investigador de doctorado de la Universidad Queen Mary de Londres, dijo que cualquier LLM implementado provocará alucinaciones. No hay forma de escapar de ello.

“Un LLM generalmente está capacitado para producir siempre un resultado, incluso cuando la entrada es muy diferente de los datos de capacitación”, dijo. “Un LLM estándar no tiene ninguna forma de saber si es capaz de responder de manera confiable una consulta o hacer una predicción”.

LexisNexis está intentando mitigar ese problema de varias maneras. Para empezar, se trata de entrenar modelos con su propio y vasto conjunto de datos legales para compensar algunos de los problemas de confiabilidad que hemos visto con los modelos fundamentales. Reihl dice que la compañía también está trabajando con la jurisprudencia más actual en las bases de datos, por lo que no habrá problemas de tiempo como con ChatGPT, que solo se capacitará con información de la web abierta hasta 2021.

La empresa cree que el uso de datos de formación más relevantes y oportunos debería producir mejores resultados. “Podemos asegurarnos de que cualquier caso al que se haga referencia esté en nuestra base de datos, por lo que no publicaremos una cita que no sea un caso real porque ya tenemos esos casos en la base de datos propia.”

Si bien no está claro si alguna empresa puede eliminar por completo las alucinaciones, LexisNexis está permitiendo que los abogados que usan el software vean cómo el robot encuentra la respuesta al proporcionar una referencia a la fuente.

“Así que podemos abordar esas limitaciones que tienen los grandes modelos de lenguaje combinando el poder que tienen con nuestra tecnología y brindando a los usuarios referencias al caso para que puedan validarlo ellos mismos”, dijo Reihl.

Es importante señalar que este es un trabajo en progreso y LexisNexis está trabajando con seis clientes en este momento para perfeccionar el enfoque en función de sus comentarios. El plan es lanzar herramientas impulsadas por IA en los próximos meses.