El director ejecutivo de OpenAI, Sam Altman, empezó 2025 anunciando en una entrada en el blog que 2025 sería un año importante para los agentes de IA, herramientas que pueden automatizar tareas y realizar acciones en nombre del usuario.

En enero se mostró el primer intento real de OpenAI.

OpenAI anunció que lanzaría una versión preliminar de Operator, un agente de IA de uso general que puede tomar el control de un navegador web y realizar determinadas acciones de forma independiente. Operator llegaría primero a los usuarios estadounidenses con suscripción Pro de ChatGPT, que cuesta 200 dólares. OpenAI afirma que tiene previsto ampliar esta función a más usuarios de sus planes Plus, Team y Enterprise.

«[Operator] estará pronto en otros países», afirmó el director ejecutivo de OpenAI, Sam Altman, durante una retransmisión en directo. «Desgraciadamente, en Europa tardará un poco más».

Esta versión preliminar de investigación está disponible a través de operator.chatgpt.com, pero OpenAI afirma que pronto quiere integrar Operator en todos sus clientes de ChatGPT.

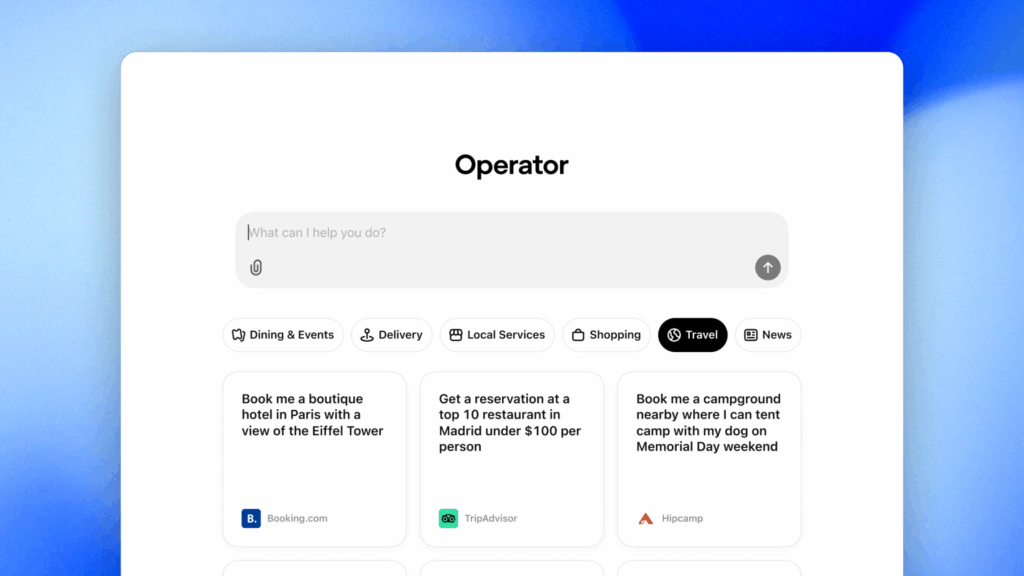

Pantalla inicial de Operator. Imagen: OpenAI

Según OpenAI, Operator promete automatizar tareas como reservas para viajes, restaurantes y compras online. Los usuarios pueden elegir entre varias categorías de tareas en la interfaz de Operator, entre las que se incluyen compras, entregas, restaurantes y viajes, todas ellas con diferentes tipos de automatización.

Cuando los usuarios de ChatGPT activan Operator, aparece una pequeña ventana con un navegador web específico que el agente utiliza para completar las tareas, junto con explicaciones de las acciones específicas que está realizando. Los usuarios pueden seguir controlando su pantalla mientras Operator está trabajando, ya que este utiliza su propio navegador dedicado.

OpenAI dice que Operator usa un modelo de agente que emplea ordenadores, o CUA (Computer-Using Agent), que mezcla las habilidades de visión del modelo GPT-4o de la compañía con las habilidades de razonamiento de los modelos más avanzados de OpenAI. El CUA está entrenado para interactuar con la interfaz de los sitios web, lo que significa que no necesita utilizar API dirigidas a desarrolladores para acceder a diferentes servicios.

En otras palabras, el CUA puede utilizar botones, navegar por menús y rellenar formularios en una página web de forma muy similar a como lo haría un ser humano.

OpenAI afirma que está colaborando con empresas como DoorDash, eBay, Instacart, Priceline, StubHub y Uber para garantizar que Operator respeta los acuerdos de condiciones de servicio de estas empresas.

Imagen:OpenAI

OpenAI explica que el modelo CUA está entrenado para solicitar la confirmación del usuario antes de finalizar tareas con efectos secundarios externos. Por ejemplo, antes de enviar un pedido o un correo electrónico, de modo que el usuario pueda verificar el trabajo del modelo antes de que se haga permanente. «Ya ha demostrado su utilidad en diversos casos, y nuestro objetivo es ampliar esa fiabilidad a una gama más amplia de tareas».

Sin embargo, OpenAI advierte que el CUA no es perfecto. La empresa afirma que «[no] espera que el CUA funcione de forma fiable en todos los escenarios por el momento».

«Actualmente, Operator no puede gestionar de forma fiable muchas tareas complejas o especializadas», añade OpenAI en un documento de soporte, «como crear presentaciones detalladas, gestionar sistemas de calendario complejos o interactuar con interfaces web muy personalizadas o no estándar».

Por precaución, OpenAI también exige supervisión para algunas tareas, como las transacciones bancarias, que el CUA y el Operator podrían realizar en su mayor parte por sí mismos. Los usuarios tendrán que intervenir para introducir la información de la tarjeta de crédito, por ejemplo. OpenAI afirma que el Operator no recopila ni captura ninguna información.

«En sitios web especialmente sensibles, como el correo electrónico, el Operator requiere la supervisión activa del usuario, lo que garantiza que este pueda detectar y corregir directamente cualquier error que pueda cometer el modelo», explica en documentos de apoyo.

Esto limita la utilidad de Operator, sin duda, pero también garantiza que el agente no tenga alucinaciones y, por ejemplo, se gaste el pago de la hipoteca en sillones decorativos. Google adoptó un enfoque similar con su agente de IA Project Mariner, que tampoco completa información como números de tarjetas de crédito.

Limitaciones

Operator tiene algunas limitaciones que vale la pena señalar.

Hay límites de velocidad, tanto diarios como dependientes de la tarea. OpenAI afirma que Operator puede realizar varias tareas a la vez, pero que existen «límites dinámicos» al respecto. También hay un límite de uso general que se restablece a diario.

En esta fase de lanzamiento, Operator también se negará a realizar tareas por motivos de seguridad, como enviar correos electrónicos (a pesar de que el CUA es capaz de hacerlo) y eliminar eventos del calendario. OpenAI afirma que esto cambiará en el futuro, pero no da una fecha aproximada.

Operator también puede «atascarse» si se encuentra con una interfaz, un campo de contraseña o una comprobación CAPTCHA especialmente complejos. Según OpenAI, cuando esto ocurra, pedirá al usuario que tome el control.

Un futuro con agentes

OpenAI ha tardado bastante en desarrollar un agente de IA en comparación con sus rivales (véanse los agentes de Rabbit, Google y Anthropic), lo que puede tener algo que ver con los riesgos de seguridad que plantea esta tecnología.

Cuando un sistema de IA puede llevar a cabo acciones en la web, se abre la puerta a casos de uso mucho más peligrosos por parte de actores malintencionados. Se podrían automatizar agentes de IA para orquestar estafas de phishing o ataques DDoS, o hacer que compren entradas para un concierto antes que nadie. Especialmente para una herramienta tan utilizada como ChatGPT, es crucial que OpenAI tome medidas para evitar ese tipo de abusos.

OpenAI parece considerar que Operator es lo suficientemente seguro como para lanzarlo en su forma actual, al menos como avance para su investigación y pruebas.

«Operator emplea herramientas que buscan limitar la susceptibilidad del modelo a indicaciones maliciosas, instrucciones ocultas e intentos de phishing», explica OpenAI en su sitio web. «Un sistema de supervisión detiene la ejecución si se detecta alguna actividad sospechosa, mientras que unos procesos automatizados y revisados por humanos actualizan continuamente las medidas de seguridad».

Operator es el intento más audaz de OpenAI hasta la fecha para crear un agente de IA. Anteriormente, OpenAI lanzó Tasks, que proporciona a ChatGPT funciones de automatización sencillas, como la posibilidad de establecer recordatorios y programar indicaciones para que se ejecuten a una hora determinada cada día.

Tasks proporcionó a los usuarios de ChatGPT algunas funciones conocidas, pero necesarias, para que ChatGPT fuera tan práctico de usar como Siri o Alexa. Sin embargo, Operator muestra capacidades que la generación anterior de asistentes virtuales nunca pudo ofrecer.

Los agentes de IA se han presentado como la próxima innovación destacada en IA después de ChatGPT: una nueva tecnología que cambiará la forma en que las personas utilizan Internet y sus ordenadores. En lugar de limitarse a entregar y procesar información, los agentes pueden, en teoría, tomar medidas y hacer cosas.

Con el lanzamiento de la primera versión concreta de OpenAI sobre los agentes, pronto quedará claro hasta qué punto es realista esta visión.