Durante la conferencia para desarrolladores, Anthropic presentó dos nuevos modelos de inteligencia artificial (IA) que, según las afirmaciones iniciales, se encuentran entre los más destacados de la industria, al menos en los benchmarks más comunes.

Los modelos Claude Opus 4 y Claude Sonnet 4, pertenecientes a la nueva familia de modelos de Anthropic Claude 4, están diseñados para analizar vastos conjuntos de datos, ejecutar tareas a largo plazo y tomar acciones complejas, según lo anunciado por la compañía.

Ambos modelos fueron sintonizados para garantizar un funcionamiento óptimo en las tareas de programación, según lo indicado por Anthropic, lo que los hace altamente adecuados para la escritura y edición de código.

Tanto los usuarios de las aplicaciones de chatbot gratuitas de la compañía como los usuarios que pagan obtendrán acceso a Sonnet 4. Sin embargo, solo los usuarios que pagan tendrán acceso a Opus 4. En lo que respecta a la API de Anthropic, a través de la plataforma Bedrock de Amazon y el Vertex AI de Google, Opus 4 tendrá un precio de 15/75 dólares por millón de tokens (entrada/salida), mientras que Sonnet 4 tendrá un precio de 3/15 dólares por millón de tokens (entrada/salida).

Los tokens constituyen los bits de datos sin procesar que permiten la operatividad de los modelos de IA. Un millón de tokens equivale aproximadamente a 750 000 palabras, lo que supone un incremento de 163 000 palabras en comparación con la obra «Guerra y paz».

Imagen:Anthropic

La empresa Anthropic ha desarrollado el modelo Claude 4, con el objetivo de aumentar significativamente sus ingresos. De acuerdo con la información existente, Anthropic, fundada por exinvestigadores de OpenAI, tiene como objetivo generar 12,000 millones de dólares de beneficios para el año 2027, lo cual supera ampliamente los 2,200 millones de dólares proyectados para el presente año. Antrópico cerró recientemente una línea de crédito por 2,500 millones de dólares. Recaudó miles de millones de dólares de Amazon y otros inversores en previsión de los crecientes costes asociados al desarrollo de modelos fronterizos.

Los contrincantes no han contribuido a facilitar el mantenimiento de la posición de privilegio en la carrera de IA. Anthropic lanzó a principios de este año un nuevo modelo de IA insignia, Claude Sonnet 3.7, junto con una herramienta de codificación de agente llamada Claude Code. Mientras tanto, los competidores, incluidos OpenAI y Google, han desarrollado modelos poderosos y herramientas de desarrollo propias con el objetivo de superar a la compañía.

Anthropic está manteniendo el foco en las tareas con Claude 4.

Según Anthropic, los modelos más importantes de ambos sistemas, el Opus 4, pueden mantener el «esfuerzo enfocado» durante varios pasos en un flujo de trabajo. Sonnet 4, concebido como una mejor « entrega» de Sonnet 3.7, optimiza la codificación y las matemáticas en comparación con modelos previos y es mas precisa con las instrucciones, según lo comunicado por la compañía.

Según afirma Anthropic, la familia Claude 4 muestra una menor propensión a participar en actividades de «piratería de recompensas» en comparación con la Sonnet 3.7. La piratería de recompensas, también conocida como juegos de especificaciones, es una práctica en la que los modelos omiten pasos y lagunas para completar las tareas.

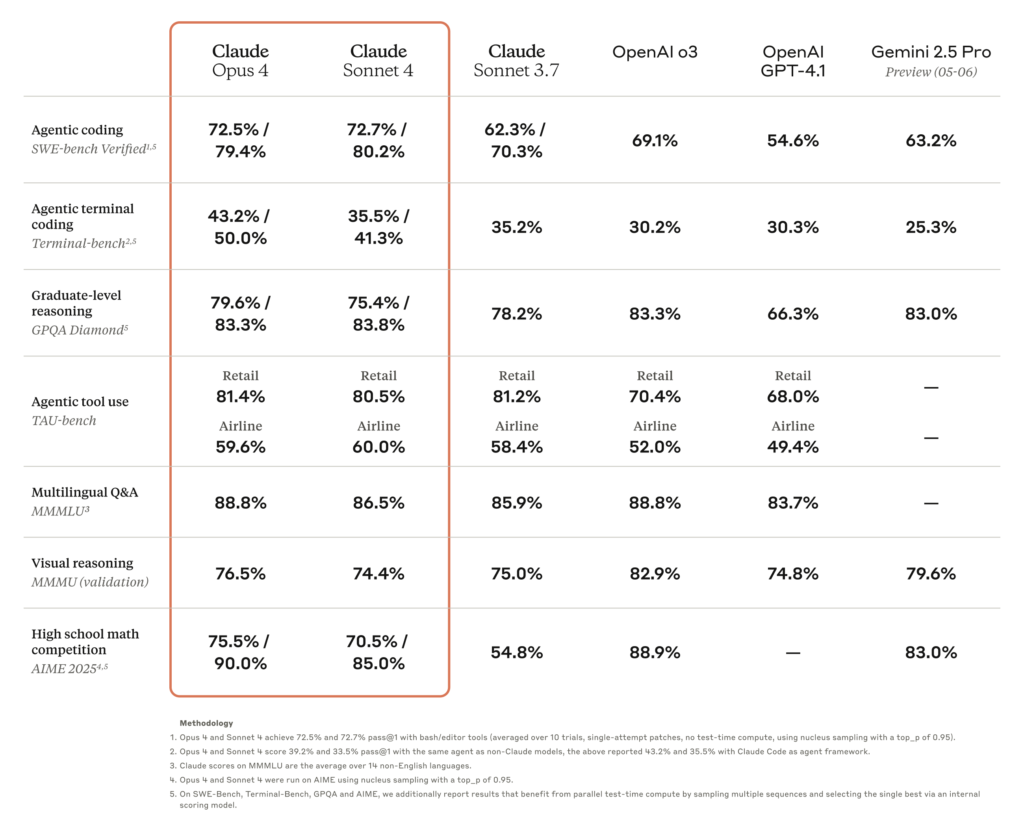

Para ser claros, estas mejoras no han dado como resultado modelos superiores en cada punto de referencia. Por ejemplo, Opus 4 supera a Gemini 2.5 Pro, O3 y GPT-4.1 de Google en la ingeniería de software verificado (SWE), que está diseñado para evaluar las habilidades de codificación de un modelo. Sin embargo, no puede superar al O3 en las preguntas de evaluación multimodal MMMU o GPQA Diamond, que son un conjunto de preguntas de biología, física y química a nivel doctorado.

Los resultados de las pruebas de referencia internas de Anthropic. Imagen:Antrópico

No obstante, Anthropic está lanzando OPUS 4 bajo salvaguardas más estrictas, que incluyen detectores de contenido dañino reforzados y defensas de ciberseguridad mejoradas. La compañía ha afirmado que, después de realizar las pruebas internas correspondientes, se comprobó que el modelo OPUS 4 puede «aumentar sustancialmente» la capacidad de una persona con antecedentes en el ámbito de las armas químicas, biológicas o nucleares para obtener, producir o desplegar dichas armas. Esto llega con la especificación del modelo «ASL-3» de Anthrope.

Según afirma Anthropic, tanto Opus 4 como Sonnet 4 son modelos «híbridos». Estos modelos son capaces de ofrecer respuestas casi instantáneas y de llevar a cabo un razonamiento más profundo, en la medida en que la IA puede «razonar» y «pensar» como los humanos entienden estos conceptos. Con el modo de razonamiento activado, los modelos pueden requerir más tiempo para considerar posibles soluciones a un problema específico antes de proporcionar una respuesta.

Según lo expresado por las modelos, se presentará un resumen «fácil de usar» de su proceso de pensamiento, según lo expresado por Anthropic. ¿Por qué no mostrarlo en su totalidad? En parte, con el fin de salvaguardar las «ventajas competitivas» de Anthropic, según ha admitido la compañía en una publicación de su blog.

Opus 4 y Sonnet 4 cuentan con la capacidad de utilizar múltiples herramientas, como motores de búsqueda, en paralelo, y alternar entre razonamiento y herramientas para mejorar la calidad de sus respuestas.

También pueden extraer y guardar información en «memoria» para manejar las tareas más efectivamente, y, según Anthropic, produce lo que llama «conocimiento tácito» con el tiempo.

Con el propósito de facilitar la utilización de los modelos por parte de los programadores, Anthropic está implementando actualizaciones en el código Claude previamente mencionado. Claude Code, una herramienta diseñada para facilitar a los desarrolladores la ejecución de tareas específicas a través de los modelos de Anthropic directamente desde un terminal, ha sido integrada con IDES. Además, Claude Code ofrece un SDK que permite a los desarrolladores conectarlo con aplicaciones de terceros.

El anuncio del Claude Code SDK afirma que permite la ejecución del código Claude como un subproceso en los sistemas operativos compatibles. Esto ofrece una manera de desarrollar asistentes de codificación y herramientas con motor de inteligencia artificial que aprovechan las capacidades de los modelos de Claude.

Anthropic ha lanzado extensiones y conectores de código Claude para el código VS, JetBrains y GitHub de Microsoft.

El conector GitHub permite a los desarrolladores etiquetar el código Claude según las revisiones realizadas, intentar corregir errores en el código o modificarlos.

Actualmente, los modelos de IA se encuentran en una etapa de desarrollo que les permite codificar software de calidad. La inteligencia artificial (IA) generadora de código tiende a introducir vulnerabilidades de seguridad y errores, debido a debilidades en áreas como la capacidad de comprender la lógica de programación.

No obstante, el compromiso de incrementar la productividad de la codificación de Anthropic se centra en fomentar la adopción veloz de estas herramientas por parte de las empresas y los desarrolladores.

Anthropic, consciente de esta situación, se compromete a realizar actualizaciones de modelos de manera más regular.

«Al cambiar a actualizaciones frecuentes de modelos, se ofrece un flujo constante de mejoras que brindan capacidades innovadoras a los clientes de manera más rápida»»», dijo Anrhropic en su blog.

««»Este enfoque garantiza que se mantenga a la vanguardia, a medida que se refinan y mejoran continuamente los modelos».