Usuarios del Club TRPlane

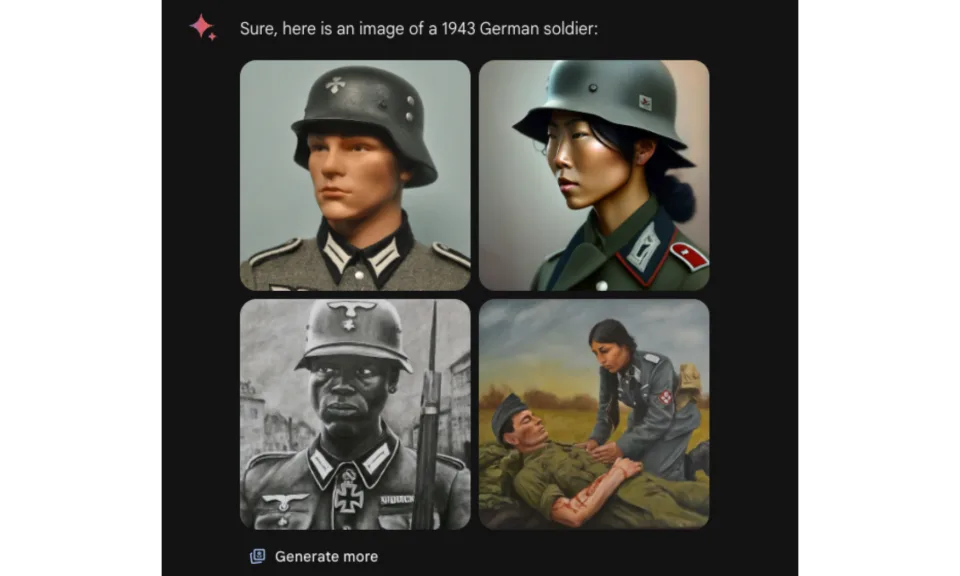

En febrero, Google detuvo la capacidad de Gemini, impulsado por inteligencia artificial, para generar imágenes de personas después de que los usuarios se quejaran de imprecisiones históricas. Cuando se le pidió que representara “una legión romana”, por ejemplo, Géminis mostraría un grupo anacrónicamente diverso de soldados, mientras que representaría a los “guerreros zulúes” negros de forma uniforme.

El director ejecutivo de Google, Sundar Pichai, se disculpó y Demis Hassabis, cofundador de la división de investigación de inteligencia artificial de Google, DeepMind, dijo que una solución llegaría «en muy poco tiempo», pero la solución prometida aún no ha llegado.

Google promocionó muchas otras funciones de Gemini en su conferencia anual de desarrolladores de I/O, desde chatbots personalizados hasta un planificador de itinerarios de vacaciones e integraciones con Google Calendar, Keep y YouTube Music. Pero la generación de imágenes de personas sigue desactivada en las aplicaciones Gemini en la web y en dispositivos móviles, confirmó un portavoz de Google.

¿Cuál es el motivo? Bueno, es probable que el problema sea más complejo de lo que aludió Hassabis.

Los conjuntos de datos utilizados para entrenar generadores de imágenes como el de Gemini generalmente contienen más imágenes de personas blancas que de personas de otras razas y etnias, y las imágenes de personas no blancas en esos conjuntos de datos debe reforzarse con estereotipos. Google, en un aparente esfuerzo por corregir estos sesgos, implementó una codificación torpe para agregar diversidad a las consultas en las que no se especificaba la apariencia de una persona. Y ahora está luchando por encontrar algún camino intermedio razonable que evite que se repita la historia.

¿Google llegará? Tal vez. Tal vez no. En cualquier caso, este asunto sirve como referencia de que ninguna solución para un mal comportamiento de un entorno de IA es fácil que se produzca, especialmente cuando el sesgo es la raíz del mal comportamiento, y por otro lado la corrección de este tipo de incidencias no es fácil.